Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Nous vous présentons notre nouveau modèle vidéo de pointe, Runway Gen-4.5. Auparavant connu sous le nom de Whisper Thunder (alias) David.

Gen-4.5 est à la pointe de la technologie et établit une nouvelle norme en matière de qualité de mouvement de génération vidéo, d'adhérence aux invites et de fidélité visuelle.

En savoir plus ci-dessous.

Runway Gen-4.5 représente des avancées significatives tant en matière d'efficacité des données de pré-entraînement que des techniques de post-entraînement pour les modèles vidéo et sert de nouveau modèle de base pour la modélisation du monde.

Gen-4.5 a obtenu 1 247 points Elo dans le classement Text to Video d'Artificial Analysis, établissant une nouvelle norme et surpassant tous les autres modèles vidéo d'IA dans le monde.

Il y a deux ans, nous avons introduit Gen-1, le premier modèle de génération vidéo disponible publiquement. Cela a permis une toute nouvelle forme d'expression créative et a créé une nouvelle catégorie de produits.

Au cours des deux dernières années, nous avons mené l'industrie en rendant les modèles vidéo plus puissants et contrôlables, en apportant des améliorations significatives au modèle de base et en permettant de nouveaux contrôles et des capacités d'édition générales.

Aujourd'hui, nous introduisons Gen-4.5 — le résultat d'un long effort de recherche pour faire progresser le pré-entraînement et le post-entraînement des modèles vidéo.

Le modèle excelle à comprendre et à exécuter des instructions complexes et séquencées. Vous pouvez spécifier une chorégraphie de caméra détaillée, des compositions de scène complexes, un timing précis des événements et des changements atmosphériques subtils, le tout dans une seule invite.

Nous restons engagés à créer des outils hautement contrôlables et flexibles qui vous aident à donner vie à votre vision exacte. En plus de Text to Video, nous apporterons tous les modes de contrôle existants (Image to Video, Keyframes, Video to Video) et plus encore à Gen-4.5.

Gen-4.5 atteint un niveau sans précédent d'exactitude physique et de précision visuelle. Les objets se déplacent avec un poids et un élan réalistes. Les surfaces se comportent comme elles le feraient dans le monde réel. Les lois de la physique peuvent être observées ou ignorées, selon votre vision.

Malgré le grand bond en avant des capacités, des limitations subsistent, telles que des échecs dans le raisonnement causal et la permanence des objets. Nous croyons que ces modes de défaillance doivent être abordés afin de faire progresser davantage la modélisation du monde, et nous travaillons activement à les résoudre.

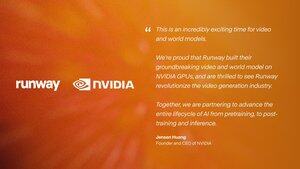

Gen-4.5 a été développé entièrement sur des GPU NVIDIA lors de la R&D initiale, du pré-entraînement, du post-entraînement et de l'inférence. Nous avons collaboré de manière extensive avec NVIDIA pour repousser les limites de ce qui est possible dans l'optimisation des modèles de diffusion vidéo, de l'efficacité de l'entraînement à la vitesse d'inférence.

L'inférence du modèle s'exécute sur les GPU de la série NVIDIA Hopper et Blackwell, offrant des performances optimisées sans compromettre la qualité. Une approche de premier plan dans l'industrie qui permet à Gen-4.5 d'atteindre des capacités sans précédent.

Nous déployons progressivement l'accès à Runway Gen-4.5. Il sera disponible pour tout le monde dans les prochains jours.

En savoir plus :

Gen-4.5 a été développé entièrement sur des GPU @nvidia lors de la R&D initiale, du pré-entraînement, du post-entraînement et de l'inférence. Nous avons collaboré de manière extensive avec NVIDIA pour repousser les limites de ce qui est possible dans l'optimisation des modèles de diffusion vidéo, de l'efficacité de l'entraînement à la vitesse d'inférence.

L'inférence du modèle s'exécute sur les GPU des séries NVIDIA Hopper et Blackwell, offrant des performances optimisées sans compromettre la qualité. Une approche pionnière dans l'industrie qui permet à Gen-4.5 d'atteindre des capacités sans précédent.

@nvidia Nous déployons progressivement l'accès à Runway Gen-4.5. Il sera disponible pour tout le monde dans les jours à venir.

En savoir plus :

425,26K

Meilleurs

Classement

Favoris