Argomenti di tendenza

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

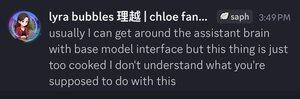

Inizia a sembrare che questo gpt oss sia stato addestrato su circa 20T token di dati distillati e sicuri, forse anche dati benchmaxxed da o3. Sembra che non ci sia un modello di base sottostante..

È questo phi 5 maxx?

Aspettando le esplorazioni di @karan4d e @repligate, lol

@karan4d @repligate Se si tratta di un pre-addestramento di pura distillazione, allora non ci potrebbe essere alcun "modello di base" da rilasciare, perché non ce n'è mai stato uno.

@karan4d @repligate Il modello è letteralmente incapace di funzionare se non utilizza il suo template di chat? Non ho mai visto una cosa del genere in un modello che è stato pre-addestrato su testo grezzo di internet.

60,6K

Principali

Ranking

Preferiti