Populaire onderwerpen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Laat me het plaatje schetsen.

Stel dat je een Humanoïde wilt die een heerlijke maaltijd kookt terwijl jij op de bank zit en Netflix kijkt.

Hoe zou dit technisch werken, aangezien de Humanoïde verschillende hersenen nodig heeft om jouw diner te maken?

De intelligentie van de robot is niet monolithisch, maar een team van AI-modules die langzame overpeinzing combineren met snelle reflexen (System 2 + System 1 ontwerp).

Het visie-taal-actie (VLA) model splitst cognitie in een redeneermodule en een reactief controlebeleid.

Terwijl de robot draait op een multi-hersenen cognitieve architectuur, zou het een speciale “chef” operator opstarten om jouw verzoek te verwerken, zoals het verkennen van de keuken met zijn camera's, het opzoeken van een recept en vervolgens zijn ledematen aansturen om groenten te gaan snijden.

Deze hersenen kunnen worden onderverdeeld in de volgende operators.

Hersenen #1:

Om een heerlijke maaltijd te koken, heb je een uitvoerende planner nodig. Het interpreteert jouw commando (“bereid diner voor”) om het doel te bepalen (maak pasta). Met behulp van natuurlijke taalbegrip beslist het welke subtaken nodig zijn (ingrediënten vinden, pasta koken, tafel dekken, enz.) en welke andere hersenen elke taak moeten afhandelen.

Het coördineert het multi-agentensysteem: het activeert gespecialiseerde modules voor visie, kennis en beweging. Deze deliberatieve hersenen (system 2) nemen beslissingen op hoog niveau, leggen de aanpak vast en wijzen verantwoordelijkheden toe voordat er fysieke bewegingen beginnen.

Hersenen #2:

Nu je het recept hebt, heb je robotogen en ruimtelijk bewustzijn nodig. Het verwerkt camerabeelden om ingrediënten, gereedschappen en hun locaties in de keuken te identificeren. Met behulp van geavanceerde computer vision ziet het de snijplank, de groenten in de koelkast, het mes op het aanrecht, enz.

Het bouwt een 3D-kaart van de omgeving en volgt relevante objecten (zoals waar het zout of de pannen zijn). Deze perceptuele hersenen (System 2) werken langzamer dan reflexen, maar bieden nauwkeurige context voor planning. Door alle betrokken stukken te herkennen, onderwijst het de robot in de echte wereld.

Hersenen #3:

Deze hersenen fungeren als de kennisbasis en het geheugen van de robot (System 2). Het haalt en analyseert informatie die nodig is voor de taak, in dit geval een geschikt recept en kookinstructies. Het kan een online kookboek raadplegen of zijn interne database voor een pastarecept, en vervolgens de stappen interpreteren (kook water, snijd knoflook, enz.).

Het herinnert feiten over de keuken (zoals waar de specerijen worden bewaard) en eerdere kookervaringen. Het biedt in wezen semantisch begrip en wereldkennis. Vervolgens berekent het abstracte instructies (karameliseer de uien) in concrete parameters (temperatuur, timing) die de robot kan uitvoeren, zodat het plan aansluit bij jouw voorkeuren.

Hersenen #4:

Met het doel en de omgeving verduidelijkt, hebben we een gedetailleerd actieplan opgesteld. Het breekt het hoog niveau doel op in geordende acties en voorwaardelijke stappen. Het plant taken (soms parallel, zoals de oven voorverwarmen terwijl de groenten worden gesneden) en stelt mijlpalen in (water gekookt, saus klaar).

Het volgt ook de voortgang en kan on-the-fly opnieuw plannen als er iets verandert (bijvoorbeeld als een ingrediënt ontbreekt). Het geeft deze actiesequentie vervolgens door aan de bewegingsniveau hersenen voor uitvoering. Nog een System 2 hersenen.

Hersenen #5:

Tijd om over te schakelen van de System 2-architectuur naar System 1, waarbij het plan wordt vertaald in concrete robotbewegingen. Voor elke actie (zoals “loop naar de koelkast” of “snijd wortels”) genereert het toepasbare trajecten voor het lichaam en de ledematen van de robot.

Deze module behandelt padplanning en inverse kinematica, berekent gewrichtspaden en hoeken zodat de robot soepel beweegt zonder botsingen. Het past doorgaans geleerde motorische beleidslijnen toe (zoals een diffusietransformerbeleid) om vloeiende bewegingen voor complexe taken te produceren.

Als Hersenen 4 zegt dat er een pan uit de koelkast moet worden gehaald, berekent Hersenen 5 hoe de robot daar moet komen en hoe de pan moet worden vastgegrepen. Waar het meerdere ledematen coördineert wanneer dat nodig is (bijvoorbeeld met twee handen een zware pan optillen). Hoog niveau intentie verandert in een samensmelting van hardware en software die in beweging is.

Hersenen #6:

Zodra een bewegingsplan is vastgesteld, is het tijd om uit te voeren. Deze laag-niveau System 1 controle hersenen stuurt de actuatoren van de robot (motoren en gewrichten). Het leest continu sensoren (gewrichtshoeken, kracht, balans) en stuurt controlesignalen om het pad te volgen.

Met behulp van controle-lussen (PID-regelaars, modelvoorspellende controle, enz.) om precisie te behouden, als de robot begint te kantelen of een mes van koers raakt, corrigeert het onmiddellijk. Dit zijn de reflexen en fijne motoriek die op milliseconde-snelheden werken.

Terwijl de robot een wortel snijdt, moduleert Hersenen 6 de kracht en past de hoek van het mes aan om uniforme plakken te krijgen zonder te slippen. Het is als de onderbewuste “spierherinnering” van het systeem, dat automatisch de laag-niveau details afhandelt.

Hersenen #7:

Het laatste stuk is gericht op continue verbetering. Tijdens en na de voorbereiding van het diner analyseert het de prestaties. Heeft het iets gemorst? Was het te langzaam met roeren?

Deze module gebruikt versterkingsleren en zelfkalibratie om de modellen van de robot in de loop van de tijd bij te werken. De kernvaardigheden van de robot zijn aanvankelijk getraind op enorme menselijke demonstraties en trial-and-error, maar je moet ze continu verfijnen.

Als het een efficiëntere snijtechniek of een betere grip op de spatel ontdekt, werkt het zijn beleid bij zodat het volgende diner nog soepeler verloopt. Deze adaptieve hersenen stellen de humanoïde in staat om vaardiger te worden met ervaring.

Codec: Operators in Actie

Hoe verbindt de architectuur van Codec deze hersenen? Elke “hersenen” draait als een aparte Operator-module in het AI-systeem van de robot. De Fabric-orchestratie van Codec biedt elke operator zijn eigen veilige, afgeschermde omgeving.

Dit betekent dat de visiemodule, taal/logica-module, planningsmodule, enz., allemaal in isolatie draaien maar communiceren via gedefinieerde interfaces.

Als één module crasht of fouten heeft, brengt het de hele robot niet naar beneden, de anderen blijven veilig draaien. Dit modulaire ontwerp maakt het ook gemakkelijk om één hersenen bij te werken of te vervangen zonder de rest te beïnvloeden, en om nieuwe gespecialiseerde operators toe te voegen indien nodig.

Deze operatorbenadering ondersteunt rechtstreeks het multi-hersenen kader. Wanneer je om diner vraagt, kan de uitvoerende hersenen van de robot (Hersenen 1) een “chef” operator opstarten die aan die taak is gewijd, terwijl andere operators perceptie en controle parallel afhandelen.

Elke operator heeft alleen toegang tot de middelen die hij nodig heeft (bijvoorbeeld de receptagent heeft mogelijk internettoegang om instructies op te halen, terwijl de controle-agent alleen met hardware communiceert), wat de veiligheid verbetert.

Het modulaire, afgeschermde ontwerp van Codec is de lijm voor al deze diverse vaardigheden die samenwerken, vergelijkbaar met microservices in software, waardoor de humanoïde betrouwbaar complexe taken zoals het koken van een diner vanaf nul kan afhandelen.

Dit is waarom $CODEC de primaire infrastructuur voor Robotica zal zijn.

23 aug 2025

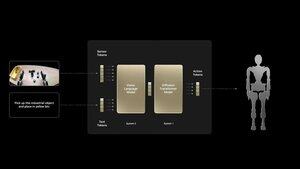

You’ll see foundation models for Humanoids continually using a System 2 + System 1 style architecture which is actually inspired by human cognition.

Most vision-language-action (VLA) models today are built as centralized multimodal systems that handle perception, language, and action within a single network.

Codec’s infrastructure is perfect for this as it treats each Operator as a sandboxed module. Meaning you can spin up multiple Operators in parallel, each running its own model or task, while keeping them encapsulated and coordinated through the same architecture.

Robots and Humanoids in general typically have multiple brains, where one Operator might handle vision processing, another handling balance, another doing high level planning etc, which can all be coordinated through Codec’s system.

Nvidia’s foundation model Issac GR00T N1 uses the two module System 2 + System 1 architecture. System 2 is a vision-language model (a version of PaLM or similar, multimodal) that observes the world through the robot’s cameras and listens to instructions, then makes a high level plan.

System 1 is a diffusion transformer policy that takes that plan and turns it into continuous motions in real time. You can think of System 2 as the deliberative brain and System 1 as the instinctual body controller. System 2 might output something like “move to the red cup, grasp it, then place it on the shelf,” and System 1 will generate the detailed joint trajectories for the legs and arms to execute each step smoothly.

System 1 was trained on tons of trajectory data (including human teleoperated demos and physics simulated data) to master fine motions, while System 2 was built on a transformer with internet pretraining (for semantic understanding).

This separation of reasoning vs. acting is very powerful for NVIDIA. It means GR00T can handle long horizon tasks that require planning (thanks to System 2) and also react instantly to perturbations (thanks to System 1).

If a robot is carrying a tray and someone nudges the tray, System 1 can correct the balance immediately rather than waiting for the slower System 2 to notice.

GR00T N1 was one of the first openly available robotics foundation models, and it quickly gained traction.

Out of the box, it demonstrated skill across many tasks in simulation, it could grasp and move objects with one hand or two, hand items between its hands, and perform multi step chores without any task specific programming. Because it wasn’t tied to a single embodiment, developers showed it working on different robots with minimal adjustments.

This is also true for Helix (Figure’s foundation model) which uses this type of architecture. Helix allows for two robots or multiple skills to operate, Codec could enable a multi agent brain by running several Operators that share information.

This “isolated pod” design means each component can be specialized (just like System 1 vs System 2) and even developed by different teams, yet they can work together.

It’s a one of a kind approach in the sense that Codec is building the deep software stack to support this modular, distributed intelligence, whereas most others only focus on the AI model itself.

Codec also leverages large pre trained models. If you’re building a robot application on it, you might plug in an OpenVLA or a Pi Zero foundation model as part of your Operator. Codec provides the connectors, easy access to camera feeds or robot APIs, so you don’t have to write the low level code to get images from a robot’s camera or to send velocity commands to its motors. It’s all abstracted behind a high level SDK.

One of the reasons I’m so bullish on Codec is exactly what I outlined above. They’re not chasing narratives, the architecture is built to be the glue between foundation models, and it frictionlessly supports multi brain systems, which is critical for humanoid complexity.

Because we’re so early in this trend, it’s worth studying the designs of industry leaders and understanding why they work. Robotics is hard to grasp given the layers across hardware and software, but once you learn to break each section down piece by piece, it becomes far easier to digest.

It might feel like a waste of time now, but this is the same method that gave me a head start during AI szn and why I was early on so many projects. Become disciplined and learn which components can co exist and which components don’t scale.

It’ll pay dividends over the coming months.

Deca Trillions ( $CODEC ) coded.

8,93K

Boven

Positie

Favorieten