Trendande ämnen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

AI behöver inte bättre modeller. Den behöver bättre filter

AI-hallucinationer är inte en sällsynt bugg - de är inbyggda i hur LLM:er fungerar.

Men @Mira_Network löser det här problemet.

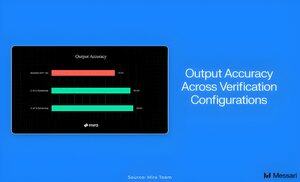

I stället för att förlita sig på en enda modell delar den upp svaren i faktiska påståenden och kör varje påstående genom ett decentraliserat nätverk av oberoende modeller för verifiering.

Topp

Rankning

Favoriter