Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Je n'ai vu personne s'impliquer autant dans le récit Robotics x AI que Trissy

Heureusement, je sais qu'il faut investir massivement quand son autisme se manifeste

Codec codé

23 août, 18:30

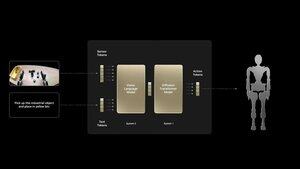

Vous verrez des modèles de fondation pour les humanoïdes utilisant continuellement une architecture de style Système 2 + Système 1, qui est en réalité inspirée de la cognition humaine.

La plupart des modèles vision-langage-action (VLA) d'aujourd'hui sont construits comme des systèmes multimodaux centralisés qui gèrent la perception, le langage et l'action au sein d'un seul réseau.

L'infrastructure de Codec est parfaite pour cela, car elle traite chaque Opérateur comme un module isolé. Cela signifie que vous pouvez faire fonctionner plusieurs Opérateurs en parallèle, chacun exécutant son propre modèle ou tâche, tout en les maintenant encapsulés et coordonnés à travers la même architecture.

Les robots et les humanoïdes en général ont typiquement plusieurs cerveaux, où un Opérateur peut gérer le traitement visuel, un autre gérer l'équilibre, un autre faire de la planification de haut niveau, etc., qui peuvent tous être coordonnés à travers le système de Codec.

Le modèle de fondation d'Nvidia, Issac GR00T N1, utilise l'architecture à deux modules Système 2 + Système 1. Le Système 2 est un modèle vision-langage (une version de PaLM ou similaire, multimodal) qui observe le monde à travers les caméras du robot et écoute les instructions, puis élabore un plan de haut niveau.

Le Système 1 est une politique de transformateur de diffusion qui prend ce plan et le transforme en mouvements continus en temps réel. Vous pouvez penser au Système 2 comme le cerveau délibératif et au Système 1 comme le contrôleur corporel instinctif. Le Système 2 pourrait produire quelque chose comme "déplacez-vous vers la tasse rouge, saisissez-la, puis placez-la sur l'étagère," et le Système 1 générera les trajectoires articulaires détaillées pour que les jambes et les bras exécutent chaque étape en douceur.

Le Système 1 a été entraîné sur des tonnes de données de trajectoire (y compris des démonstrations téléopérées par des humains et des données simulées physiquement) pour maîtriser les mouvements fins, tandis que le Système 2 a été construit sur un transformateur avec pré-entraînement sur Internet (pour la compréhension sémantique).

Cette séparation entre raisonnement et action est très puissante pour NVIDIA. Cela signifie que GR00T peut gérer des tâches à long terme qui nécessitent de la planification (grâce au Système 2) et aussi réagir instantanément aux perturbations (grâce au Système 1).

Si un robot porte un plateau et que quelqu'un pousse le plateau, le Système 1 peut corriger l'équilibre immédiatement plutôt que d'attendre que le Système 2, plus lent, le remarque.

GR00T N1 a été l'un des premiers modèles de fondation en robotique disponibles publiquement, et il a rapidement gagné en popularité.

D'emblée, il a démontré des compétences dans de nombreuses tâches en simulation, il pouvait saisir et déplacer des objets avec une main ou deux, passer des objets entre ses mains, et effectuer des tâches en plusieurs étapes sans aucune programmation spécifique à la tâche. Comme il n'était pas lié à une seule incarnation, les développeurs ont montré qu'il fonctionnait sur différents robots avec des ajustements minimes.

C'est également vrai pour Helix (le modèle de fondation de Figure) qui utilise ce type d'architecture. Helix permet à deux robots ou plusieurs compétences d'opérer, Codec pourrait permettre un cerveau multi-agent en exécutant plusieurs Opérateurs qui partagent des informations.

Ce design "pod isolé" signifie que chaque composant peut être spécialisé (tout comme le Système 1 contre le Système 2) et même développé par différentes équipes, tout en pouvant travailler ensemble.

C'est une approche unique dans le sens où Codec construit la pile logicielle profonde pour soutenir cette intelligence modulaire et distribuée, tandis que la plupart des autres se concentrent uniquement sur le modèle d'IA lui-même.

Codec tire également parti de grands modèles pré-entraînés. Si vous construisez une application robotique dessus, vous pourriez intégrer un modèle de fondation OpenVLA ou Pi Zero comme partie de votre Opérateur. Codec fournit les connecteurs, un accès facile aux flux de caméra ou aux API de robot, donc vous n'avez pas à écrire le code de bas niveau pour obtenir des images de la caméra d'un robot ou pour envoyer des commandes de vitesse à ses moteurs. Tout est abstrait derrière un SDK de haut niveau.

Une des raisons pour lesquelles je suis si optimiste sur Codec est exactement ce que j'ai décrit ci-dessus. Ils ne poursuivent pas des récits, l'architecture est construite pour être le lien entre les modèles de fondation, et elle soutient sans friction les systèmes multi-cerveaux, ce qui est critique pour la complexité humanoïde.

Comme nous sommes encore au début de cette tendance, il vaut la peine d'étudier les conceptions des leaders de l'industrie et de comprendre pourquoi elles fonctionnent. La robotique est difficile à saisir compte tenu des couches entre le matériel et le logiciel, mais une fois que vous apprenez à décomposer chaque section pièce par pièce, cela devient beaucoup plus facile à digérer.

Cela peut sembler une perte de temps maintenant, mais c'est la même méthode qui m'a donné une longueur d'avance pendant la saison de l'IA et pourquoi j'étais en avance sur tant de projets. Devenez discipliné et apprenez quels composants peuvent coexister et quels composants ne sont pas évolutifs.

Cela rapportera des dividendes dans les mois à venir.

Deca Trillions ( $CODEC ) codé.

5,54K

Meilleurs

Classement

Favoris