トレンドトピック

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

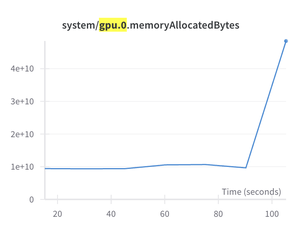

わかりました、助けが必要です! 週末にGPT-OSSの微調整を試みました。~100ステップで動作し、CUDAメモリ不足エラーをスローします

私の推測では、時々、すべてのトークンが 1 人のエキスパートにルーティングされると思います。 その後、トレーニングがクラッシュします。

簡単な解決策はありますか?これまでに MoE を微調整したことがありません

😒

23.69K

トップ

ランキング

お気に入り