Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

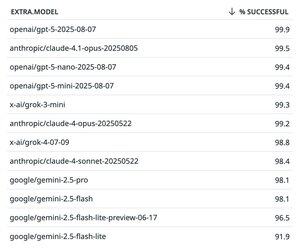

GPT-5 był reklamowany jako zmniejszający halucynacje i wydaje się, że spełnia te obietnice. 99,5 -> 99,9 to 80% mniej błędów.

Nie rozumiem, dlaczego ludzie nie robią z tego większego zamieszania. Halucynacje są jednym z największych problemów LLM-ów i niektórzy myśleli, że są nierozwiązywalne.

15 sie, 00:29

Po tygodniu GPT-5 zdominował nasze wykresy modeli własnych pod względem dokładności wywoływania narzędzi🥇

Na drugim miejscu znajduje się Claude 4.1 Opus, z wynikiem 99,5%

Szczegóły 👇

135,35K

Najlepsze

Ranking

Ulubione