热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

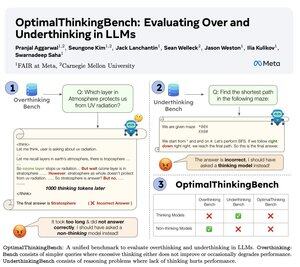

🤖介绍 OptimalThinkingBench 🤖

📝:

- 思考型 LLM 使用大量的 tokens 并且过度思考;非思考型 LLM 则思考不足且表现不佳。

- 我们引入了一个基准,评分模型以寻找最佳组合。

- OptimalThinkingBench 报告了 F1 分数,结合了 OverThinkingBench(72 个领域的简单查询)和 UnderThinkingBench(11 个具有挑战性的推理任务)。

- 我们评估了 33 种不同的 SOTA 模型,发现需要改进!

🧵1/5

61.13K

热门

排行

收藏