Populaire onderwerpen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

CodecFlow

Uitvoeringslaag voor AI-operators en robotica op @Solana

CA:69LjZUUzxj3Cb3Fxeo1X4QpYEQTboApkhXTysPpbpump

VLAs zijn nog steeds erg nieuw en veel mensen vinden het moeilijk om het verschil tussen VLAs en LLMs te begrijpen.

Hier is een diepgaande analyse van hoe deze AI-systemen verschillen in redeneren, waarnemen en handelen. Deel 1.

Laten we de belangrijkste onderscheidingen uiteenzetten en hoe AI-agenten die zijn verpakt rond een LLM verschillen van operatoragenten die VLA-modellen gebruiken:

1. Waarnemen: Hoe ze de wereld waarnemen

Agent (LLM): Verwerkt tekst of gestructureerde gegevens, bijvoorbeeld JSON, API's en soms afbeeldingen. Het is als een brein dat werkt met schone, geabstraheerde invoer. Denk aan het lezen van een handleiding of het parseren van een spreadsheet. Geweldig voor gestructureerde omgevingen, maar beperkt door wat er aan wordt gevoed.

Operator (VLA): Ziet ruwe, realtime pixels van camera's, plus sensorgegevens (bijv. aanraking, positie) en proprioceptie (zelfbewustzijn van beweging). Het is als navigeren door de wereld met ogen en zintuigen, gedijend in dynamische, rommelige omgevingen zoals UI's of fysieke ruimtes.

2. Handelen: Hoe ze interageren

Agent: Handelt door functies, tools of API's aan te roepen. Stel je voor dat het een manager is die precieze instructies geeft zoals "boek een vlucht via de Expedia API." Het is doelbewust, maar afhankelijk van vooraf gebouwde tools en duidelijke interfaces.

Operator: Voert continue, laagdrempelige acties uit, zoals het bewegen van een muiscursor, typen of het bedienen van robotgewrichten. Het is als een bekwame werknemer die direct de omgeving manipuleert, ideaal voor taken die real-time precisie vereisen.

3. Controle: Hoe ze beslissingen nemen

Agent: Volgt een langzame, reflectieve cyclus: plannen, een tool aanroepen, het resultaat evalueren, herhalen. Het is token-gebonden (beperkt door tekstverwerking) en netwerk-gebonden (wachtend op API-responsen). Dit maakt het methodisch maar traag voor real-time taken.

Operator: Werkt, neemt stapgewijze beslissingen in een strakke feedbacklus. Denk aan een gamer die onmiddellijk reageert op wat er op het scherm staat. Deze snelheid maakt vloeiende interactie mogelijk, maar vereist robuuste real-time verwerking.

4. Gegevens om te leren: Wat hun training aandrijft

Agent: Getraind op enorme tekstcorpora, instructies, documentatie of RAG (Retrieval-Augmented Generation) datasets. Het leert van boeken, code of FAQ's, en excelleert in redeneren over gestructureerde kennis.

Operator: Leert van demonstraties (bijv. video's van mensen die taken uitvoeren), teleoperatielogs of beloningssignalen. Het is als leren door te kijken en te oefenen, perfect voor taken waar expliciete instructies schaars zijn.

5. Faalmodi: Waar ze falen

Agent: Gevoelig voor hallucinatie (het verzinnen van antwoorden) of broze langetermijnplannen die in elkaar storten als één stap faalt. Het is als een strateeg die te veel nadenkt of de situatie verkeerd inschat.

Operator: Heeft te maken met covariate shift (wanneer trainingsgegevens niet overeenkomen met de echte wereldomstandigheden) of cumulatieve fouten in controle (kleine fouten die zich opstapelen). Het is als een bestuurder die de controle verliest op een onbekende weg.

6. Infra: De technologie erachter

Agent: Vertrouwt op een prompt/router om te beslissen welke tools aan te roepen, een toolregister voor beschikbare functies, en geheugen/RAG voor context. Het is een modulaire opzet, als een commandocentrum dat taken coördineert.

Operator: Heeft video-invoerpijplijnen nodig, een act server voor real-time controle, een veiligheidsbescherming om schadelijke acties te voorkomen, en een replaybuffer om ervaringen op te slaan. Het is een high-performance systeem dat is gebouwd voor dynamische omgevingen.

7. Waar elk uitblinkt: Hun sterke punten

Agent: Dominant in workflows met schone API's (bijv. automatisering van bedrijfsprocessen), redeneren over documenten (bijv. samenvatten van rapporten) of codegeneratie. Het is je go-to voor gestructureerde, hoog-niveau taken.

Operator: Uitblinkt in rommelige, API-loze omgevingen zoals het navigeren door onhandige UI's, het bedienen van robots of het aanpakken van game-achtige taken. Als het gaat om real-time interactie met onvoorspelbare systemen, is VLA koning.

8. Mentale Model: Planner + Doener

Denk aan de LLM Agent als de planner: het breekt complexe taken op in duidelijke, logische doelen.

De VLA Operator is de doener, die die doelen uitvoert door direct te interageren met pixels of fysieke systemen. Een controleur (een ander systeem of agent) monitort de uitkomsten om succes te waarborgen.

$CODEC

21,7K

Codecflow Optr biedt een uniforme benadering voor het bouwen van agenten die kunnen zien, redeneren en handelen in digitale en fysieke omgevingen. Of het nu gaat om het automatiseren van desktopworkflows, het besturen van robotarmen of het testen in simulatie, het gebruikt hetzelfde mentale model en dezelfde primitieve elementen.

Louround 🥂21 aug, 04:10

Dips in een bullmarkt zijn bedoeld om gekocht te worden, vooral bij projecten met grote katalysatoren.

We weten allemaal dat AI het verhaal van deze cyclus is, gestart door ai16z en Virtuals vorig jaar.

Mijn weddenschap is dat de markt zich zal richten op meer complexe en geavanceerde technologieën zoals VLAs, en laat me je vertellen waarom.

LLMs (Large Language Models) lezen en schrijven voornamelijk tekst: ze zijn geweldig in uitleggen, plannen en genereren van instructies, maar ze controleren op zichzelf geen motoren of interageren met de fysieke wereld (zoals je misschien hebt ervaren met chatgpt).

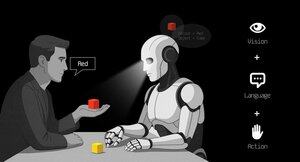

VLAs (Vision Language Action modellen) verschillen van LLMs omdat ze multimodale systemen zijn die naar dingen kijken (visie), instructies begrijpen (taal) en direct acties produceren. Het is alsof je een robot vertelt een rode beker op te pakken en vervolgens zijn arm beweegt om dit te doen.

VLAs worden getraind op voorbeelden die afbeeldingen/video + instructies + echte actie-traces (hoe een robot daadwerkelijk bewoog) combineren, en ze moeten snel en veilig in real-time functioneren. LLMs aan de andere kant worden getraind op enorme tekstcollecties en richten zich op redeneertaken en taalopdrachten.

TL;DR LLMs denken en spreken terwijl VLAs zien, redeneren en handelen.

Zoals je kunt zien, zijn VLAs een belangrijke aanvulling op LLMs en zullen ze opmerkelijk de volgende 0 naar 1 innovatie in de algehele economie mogelijk maken, die robotica zal zijn. Een meerderheid van de investeringsfondsen wijst een groot deel van hun investeringen toe aan deze sector, gezien als de volgende logische evolutie in de AI-industrie.

Ik heb een tijdje geleden al een post gemaakt over de huidige leider in de cryptomarkt, @codecopenflow, die geen kapitaal heeft opgehaald (eerlijk lancering) maar wel geavanceerde producten levert en momenteel op $23M FDV zit.

Ter informatie, andere crypto-concurrenten hebben $20m opgehaald ( @openmind_agi) bij wat waarschijnlijk een FDV van $200M tot $300M ++ is, terwijl er nog geen product of gemeenschap is gebouwd en geleverd.

Wat Codec een leidend project in de sector maakt, is dat ze een cruciale bottleneck in robotica en AI aanpakken, namelijk de moeilijkheid om alle AI-tools samen te laten werken. Laat me uitleggen.

Hun laatste release, OPTR (operator), is een toolkit die helpt bij het bouwen van operators die kunnen interageren op meerdere platforms zoals robots, desktops, browsers of simulaties. Het doel van een operator is om te zien, redeneren en handelen (VLA) in zowel digitale (computers) als fysieke (robots) werelden.

Deze toolkit dient als kerninfrastructuur voor robotteams die hun product willen testen en het algehele proces willen verbeteren door een uniforme ervaring te bieden in plaats van aparte ervaringen voor webbrowsers, simulaties of robots. Dit maakt de operator in wezen adaptief en autonoom, ongeacht zijn omgeving.

Dus je begrijpt het, het zal veel tijd besparen voor bedrijven en ontwikkelaars die eerder elke stap handmatig moesten doorlopen en waar je tijd kunt besparen, kun je geld besparen.

Het zal Codec ook in staat stellen om hun eigen operatorprojecten te bouwen en nieuwe capaciteiten relatief snel op de markt te brengen, met name via hun marktplaats.

TL;DR: Je hebt waarschijnlijk video's gezien van robots die tissues vouwen, dozen sorteren of op verschillende elementen springen. Ze zijn allemaal getraind voor deze zeer specifieke gebruiksgevallen, en helaas kan één vaardigheid niet opnieuw worden gebruikt in een andere omgeving zoals een mens dat zou kunnen doen. OPTR van Codec lost dit op door vaardigheden overdraagbaar te maken tussen omgevingen en situaties, waardoor training en ontwikkeling veel sneller en goedkoper worden voor bedrijven.

Dit is waarom Codec zo interessant is in het verenigen van de digitale wereld met de fysieke wereld.

$CODEC, Coded.

2,58K

Onderzoeksbureau @epochbiz (van @ZoomerOracle) heeft een gedetailleerd onderzoeksrapport gepubliceerd over CodecFlow.

Mis het niet.

$CODEC

epoch_19 aug, 21:07

$CODEC is zich aan het voorbereiden om de beste optie te zijn als onchain spel voor Robotica

Onderzoeksartikel over @codecopenflow is nu live op 🤖

3,64K

We zien een toename van nepaccounts die beweren CodecFlow te vertegenwoordigen.

De enige officiële X/Twitter-accounts zijn @codecopenflow en @RoboMove.

Alle andere geverifieerde kanalen staan op onze website.

Er is maar één token, $CODEC.

Blijf waakzaam en meld verdachte accounts.

Herpost en deel alstublieft om het nieuws te verspreiden.

3,33K

RoboMove is een showcase die volledig wordt aangedreven door de CodecFlow-infrastructuur.

Er is geen aparte token. $CODEC is het enige token binnen het ecosysteem.

@RoboMove is slechts één voorbeeld van wat er mogelijk is met CodecFlow Operators.

Binnenkort kunnen ontwikkelaars hun eigen geavanceerde systemen bouwen op CodecFlow met behulp van onze SDK en tooling.

Het platform is opzettelijk open en uitbreidbaar, waardoor eindeloze gebruiksscenario's mogelijk zijn, van robotbesturing tot GUI-automatisering.

⚠️ Trap niet in valse tokens of imitators. Controleer altijd aan de hand van officiële bronnen.

3,85K

We zijn blij te zien dat de Chinese gemeenschap CodecFlow opmerkt en houdt van wat we aan het bouwen zijn.

Welkom. We zijn net begonnen. Er komt nog veel meer aan.

0xFunky13 jul 2025

De openbare verkoop van PUMP is voorbij, oorspronkelijk had ik ook een groot bedrag op Bybit, er is maar 1/2 op de ketting geplaatst, en uiteindelijk is alleen de ketting gelukt, maar gelukkig was er geen afdekking vooraf...

Daarover gesproken, veel mensen in de AI-gemeenschap hebben het de laatste tijd over VLA (Vision-Language-Action) gehad.

Ik heb specifiek onderzocht of er iemand aan VLA-gerelateerde projecten in de keten werkte, en zag dit CodecFlow-@Codecopenflow project en kocht een beetje.

== Wat doet CodecFlow ==

Een korte introductie tot VLA, VLA is een modelarchitectuur waarmee AI niet alleen kan "spreken", maar ook kan "doen".

Traditionele LLM's (zoals GPT) kunnen alleen taal begrijpen en suggesties geven, maar het doet geen praktische handelingen, klikt niet op schermen of pakt geen objecten.

Het VLA-model betekent dat het drie belangrijke mogelijkheden integreert:

1. Visie: Begrijp schermen, schermafbeeldingen, camera-invoer of sensorgegevens

2. Taal: Begrijp de instructies voor menselijke natuurlijke taal

3. Actie: Genereer uitvoerbare opdrachten zoals muisklikken, toetsenbordinvoer en bedien robotarmen

CodecFlow voert VLA uit op de keten en alle operationele processen kunnen ook worden geüpload naar de keten, die kan worden gecontroleerd, geverifieerd en afgewikkeld.

Simpel gezegd, het is de infrastructuur van "AI-bots".

== Waarom heb ik speciale aandacht besteed aan dit project? ==

Ik ontdekte dat hun ontwikkelaars een belangrijke bijdrage leveren aan LeRobot, het populairste open source-project in de VLA-ruimte!

LeRobot is de belangrijkste basis voor het bouwen van VLA-modellen in de open source-wereld, inclusief lichtgewicht VLA's zoals SmolVLA die op laptops kunnen draaien.

Het betekent dat dit team de VlA-architectuur echt begrijpt en Robot begrijpt.

Ik zie dat ze ook blijven bouwen, en de valutaprijs stijgt ook gestaag, ik ben erg optimistisch over het VLA-spoor, en vanuit de algemene trend zijn VLA en robots inderdaad de toekomst in de markt.

• Web2-giganten (Google, Meta, Tesla) zetten momenteel volop in op VLA- en bottraining;

• Web3-projecten hebben zelden VLA-applicaties die taken kunnen uitvoeren, en ze zijn nog steeds erg schaars

• VLA's hebben de mogelijkheid om een enorme waarde te spelen in scenario's zoals DePIN, Web Automation, on-chain AI Agent-uitvoering, enz.

CA:69LjZUUzxj3Cb3Fxeo1X4QpYEQTboApkhXTysPpbpump

Altijd DYOR。

4,11K

Boven

Positie

Favorieten

Populair op onchain

Populair op X

Recente topfinanciering

Belangrijkste