Tendencias del momento

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Artificial Analysis

Análisis independiente de modelos de IA y proveedores de alojamiento: elija el mejor modelo y proveedor de API para su caso de uso

DeepSeek lanza V3.1, unificando V3 y R1 en un modelo de razonamiento híbrido con un aumento incremental en inteligencia

Aumento incremental de inteligencia: Los resultados iniciales de evaluación para DeepSeek V3.1 muestran un Índice de Inteligencia de Análisis Artificial de 60 en modo de razonamiento, por encima de la puntuación de 59 de R1. En modo no razonamiento, V3.1 alcanza una puntuación de 49, un mayor aumento respecto a la puntuación anterior de V3 0324 de 44. Esto deja a V3.1 (razonamiento) detrás del último Qwen3 235B 2507 de Alibaba (razonamiento) - DeepSeek no ha recuperado el liderazgo.

Razonamiento híbrido: @deepseek_ai ha pasado a un modelo de razonamiento híbrido por primera vez, apoyando tanto modos de razonamiento como no razonamiento. El movimiento de DeepSeek hacia un modelo de razonamiento híbrido unificado imita el enfoque adoptado por OpenAI, Anthropic y Google. Sin embargo, es interesante notar que Alibaba recientemente abandonó su enfoque híbrido que favorecía para Qwen3 con sus lanzamientos separados de los modelos de razonamiento y de instrucción de Qwen3 2507.

Llamadas a funciones / uso de herramientas: Aunque DeepSeek afirma haber mejorado las llamadas a funciones para el modelo, DeepSeek V3.1 no soporta llamadas a funciones cuando está en modo de razonamiento. Esto probablemente limitará sustancialmente su capacidad para soportar flujos de trabajo agentes con requisitos de inteligencia, incluyendo en agentes de codificación.

Uso de tokens: DeepSeek V3.1 obtiene puntuaciones incrementalmente más altas en modo de razonamiento que DeepSeek R1, y utiliza ligeramente menos tokens en las evaluaciones que usamos para el Índice de Inteligencia de Análisis Artificial. En modo no razonamiento, utiliza ligeramente más tokens que V3 0324, pero aún así varias veces menos que en su propio modo de razonamiento.

API: La API de primera parte de DeepSeek ahora sirve el nuevo modelo DeepSeek V3.1 en sus puntos finales de chat y razonamiento, simplemente cambiando si el token de pensamiento final </think> se proporciona al modelo en la plantilla de chat para controlar si el modelo razonará.

Arquitectura: DeepSeek V3.1 es arquitectónicamente idéntico a los modelos anteriores V3 y R1, con 671B de parámetros totales y 37B de parámetros activos.

Implicaciones: Aconsejaríamos precaución al hacer suposiciones sobre lo que esta versión implica sobre el progreso de DeepSeek hacia un futuro modelo referido en rumores como V4 o R2. Notamos que DeepSeek lanzó previamente el modelo final construido sobre su arquitectura V2 el 10 de diciembre de 2024, solo dos semanas antes de lanzar V3.

71,16K

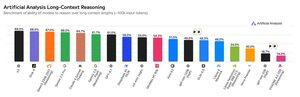

Anunciando el Análisis Artificial de Razonamiento de Largo Contexto (AA-LCR), un nuevo estándar para evaluar el rendimiento en contextos largos a través de pruebas de capacidades de razonamiento en múltiples documentos largos (~100k tokens)

El enfoque de AA-LCR es replicar el trabajo de conocimiento real y las tareas de razonamiento, probando capacidades críticas para las aplicaciones modernas de IA que abarcan el análisis de documentos, la comprensión de bases de código y flujos de trabajo complejos de múltiples pasos.

AA-LCR consiste en 100 preguntas difíciles basadas en texto que requieren razonamiento a través de múltiples documentos del mundo real que representan ~100k tokens de entrada. Las preguntas están diseñadas de tal manera que las respuestas no se pueden encontrar directamente, sino que deben deducirse de múltiples fuentes de información, con pruebas humanas que verifican que cada pregunta requiere una inferencia genuina en lugar de recuperación.

Puntos clave:

➤ Los modelos líderes de hoy logran ~70% de precisión: los tres primeros lugares son para OpenAI o3 (69%), xAI Grok 4 (68%) y Qwen3 235B 2507 Thinking (67%)

➤👀 ¡También ya tenemos resultados de gpt-oss! 120B se desempeña cerca de o4-mini (alto), en línea con las afirmaciones de OpenAI sobre el rendimiento del modelo. Pronto seguiremos con un Índice de Inteligencia para los modelos.

➤ 100 preguntas difíciles basadas en texto que abarcan 7 categorías de documentos (Informes de Empresas, Informes de la Industria, Consultas Gubernamentales, Academia, Legal, Materiales de Marketing e Informes de Encuestas)

➤ ~100k tokens de entrada por pregunta, requiriendo que los modelos soporten un mínimo de 128K de ventana de contexto para puntuar en este estándar

➤ ~3M de tokens de entrada únicos en ~230 documentos para ejecutar el estándar (los tokens de salida varían típicamente según el modelo)

➤ El enlace al conjunto de datos en 🤗 @HuggingFace está abajo

Estamos añadiendo AA-LCR al Índice de Inteligencia de Análisis Artificial, y llevando el número de versión a v2.2. El Índice de Inteligencia de Análisis Artificial v2.2 ahora incluye: MMLU-Pro, GPQA Diamond, AIME 2025, IFBench, LiveCodeBench, SciCode y AA-LCR.

Todos los números están actualizados en el sitio ahora. Descubre qué modelos incluye el Índice de Inteligencia de Análisis Artificial v2.2 👇

28,87K

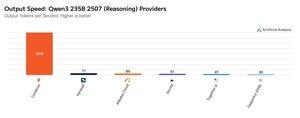

Cerebras ha estado demostrando su capacidad para alojar grandes MoEs a velocidades muy altas esta semana, lanzando los puntos finales Qwen3 235B 2507 y Qwen3 Coder 480B a >1,500 tokens de salida/s

➤ @CerebrasSystems ahora ofrece puntos finales tanto para Qwen3 235B 2507 Razonamiento como No-razonamiento. Ambos modelos tienen 235B de parámetros totales con 22B activos.

➤ Qwen 3 235B 2507 Razonamiento ofrece una inteligencia comparable a o4-mini (alta) y DeepSeek R1 0528. La variante No-razonamiento ofrece una inteligencia comparable a Kimi K2 y muy por encima de GPT-4.1 y Llama 4 Maverick.

➤ Qwen3 Coder 480B tiene 480B de parámetros totales con 35B activos. Este modelo es particularmente fuerte para la codificación agente y se puede utilizar en una variedad de herramientas de agentes de codificación, incluyendo la Qwen3-Coder CLI.

Los lanzamientos de Cerebras representan la primera vez que este nivel de inteligencia ha estado accesible a estas velocidades de salida y tienen el potencial de desbloquear nuevos casos de uso, como usar un modelo de razonamiento para cada paso de un agente sin tener que esperar minutos.

25,34K

Parte superior

Clasificación

Favoritos