Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Artificial Analysis

Niezależna analiza modeli AI i dostawców usług hostingowych - wybierz najlepszego dostawcę modelu i API dla swojego przypadku użycia

DeepSeek uruchamia V3.1, łącząc V3 i R1 w hybrydowy model rozumowania z stopniowym wzrostem inteligencji

Stopniowy wzrost inteligencji: Wstępne wyniki benchmarków dla DeepSeek V3.1 pokazują wskaźnik Inteligencji Analizy Sztucznej na poziomie 60 w trybie rozumowania, w porównaniu do wyniku R1 wynoszącego 59. W trybie nie-rozumowania V3.1 osiąga wynik 49, co stanowi większy wzrost w porównaniu do wcześniejszego wyniku V3 0324 wynoszącego 44. To pozostawia V3.1 (rozumienie) za najnowszym Qwen3 235B 2507 Alibaba (rozumienie) - DeepSeek nie odzyskał prowadzenia.

Hybrydowe rozumowanie: @deepseek_ai po raz pierwszy przeszedł na hybrydowy model rozumowania - wspierając zarówno tryby rozumowania, jak i nie-rozumowania. Przejście DeepSeek na zjednoczony hybrydowy model rozumowania naśladuje podejście przyjęte przez OpenAI, Anthropic i Google. Warto jednak zauważyć, że Alibaba niedawno porzucił swoje preferencje dotyczące hybrydowego podejścia dla Qwen3, wydając osobno modele rozumowania i instrukcji Qwen3 2507.

Wywoływanie funkcji / użycie narzędzi: Chociaż DeepSeek twierdzi, że poprawił wywoływanie funkcji dla modelu, DeepSeek V3.1 nie obsługuje wywoływania funkcji w trybie rozumowania. Prawdopodobnie znacznie ograniczy to jego zdolność do wspierania agentowych przepływów pracy z wymaganiami inteligencji, w tym w agentach kodujących.

Użycie tokenów: DeepSeek V3.1 osiąga stopniowo wyższe wyniki w trybie rozumowania niż DeepSeek R1 i używa nieco mniej tokenów w ocenach, które wykorzystujemy do wskaźnika Inteligencji Analizy Sztucznej. W trybie nie-rozumowania używa nieco więcej tokenów niż V3 0324 - ale wciąż kilka razy mniej niż w swoim własnym trybie rozumowania.

API: Pierwsze API DeepSeek teraz obsługuje nowy model DeepSeek V3.1 zarówno na ich punktach końcowych czatu, jak i rozumowania - wystarczy zmienić, czy token końcowy myślenia </think> jest dostarczany do modelu w szablonie czatu, aby kontrolować, czy model będzie rozumował.

Architektura: DeepSeek V3.1 jest architektonicznie identyczny z wcześniejszymi modelami V3 i R1, z 671B całkowitych parametrów i 37B aktywnych parametrów.

Implikacje: Zalecamy ostrożność w formułowaniu jakichkolwiek założeń dotyczących tego, co ta wersja implikuje na temat postępów DeepSeek w kierunku przyszłego modelu, który w plotkach nazywany jest V4 lub R2. Zauważamy, że DeepSeek wcześniej wydał ostateczny model zbudowany na swojej architekturze V2 10 grudnia 2024 roku, zaledwie dwa tygodnie przed wydaniem V3.

71,16K

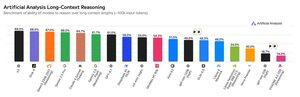

Ogłaszamy Artificial Analysis Long Context Reasoning (AA-LCR), nowy benchmark do oceny wydajności w długim kontekście poprzez testowanie zdolności rozumowania w wielu długich dokumentach (~100k tokenów)

Celem AA-LCR jest odwzorowanie rzeczywistej pracy wiedzy i zadań rozumowania, testując zdolności krytyczne dla nowoczesnych aplikacji AI obejmujących analizę dokumentów, zrozumienie kodu oraz złożone wieloetapowe przepływy pracy.

AA-LCR to 100 trudnych pytań opartych na tekście, które wymagają rozumowania w oparciu o wiele rzeczywistych dokumentów reprezentujących ~100k tokenów wejściowych. Pytania są zaprojektowane w taki sposób, aby odpowiedzi nie mogły być bezpośrednio znalezione, lecz muszą być wywnioskowane z wielu źródeł informacji, przy czym testy przeprowadzane przez ludzi weryfikują, że każde pytanie wymaga prawdziwego wnioskowania, a nie tylko wyszukiwania.

Kluczowe informacje:

➤ Dzisiejsze wiodące modele osiągają ~70% dokładności: pierwsze trzy miejsca zajmują OpenAI o3 (69%), xAI Grok 4 (68%) oraz Qwen3 235B 2507 Thinking (67%)

➤👀 Mamy już również wyniki gpt-oss! 120B osiąga wyniki bliskie o4-mini (wysokie), zgodnie z twierdzeniami OpenAI dotyczącymi wydajności modeli. Wkrótce przedstawimy Indeks Inteligencji dla modeli.

➤ 100 trudnych pytań opartych na tekście obejmujących 7 kategorii dokumentów (Raporty Firmowe, Raporty Branżowe, Konsultacje Rządowe, Akademia, Prawo, Materiały Marketingowe i Raporty z Badań)

➤ ~100k tokenów wejściowych na pytanie, wymagające od modeli wsparcia dla minimalnego okna kontekstowego 128K, aby uzyskać wynik w tym benchmarku

➤ ~3M unikalnych tokenów wejściowych obejmujących ~230 dokumentów do przeprowadzenia benchmarku (tokeny wyjściowe zazwyczaj różnią się w zależności od modelu)

➤ Link do zestawu danych na 🤗 @HuggingFace znajduje się poniżej

Dodajemy AA-LCR do Indeksu Inteligencji Artificial Analysis i podnosimy numer wersji do v2.2. Indeks Inteligencji Artificial Analysis v2.2 teraz obejmuje: MMLU-Pro, GPQA Diamond, AIME 2025, IFBench, LiveCodeBench, SciCode i AA-LCR.

Wszystkie liczby są teraz zaktualizowane na stronie. Sprawdź, które modele znajdują się w Indeksie Inteligencji Artificial Analysis v2.2 👇

28,86K

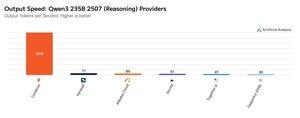

Cerebras demonstruje swoją zdolność do hostowania dużych MoEs z bardzo wysokimi prędkościami w tym tygodniu, uruchamiając punkty końcowe Qwen3 235B 2507 i Qwen3 Coder 480B przy >1,500 tokenów wyjściowych/s

➤ @CerebrasSystems teraz oferuje punkty końcowe zarówno dla Qwen3 235B 2507 Reasoning, jak i Non-reasoning. Oba modele mają łącznie 235B parametrów, z 22B aktywnymi.

➤ Qwen 3 235B 2507 Reasoning oferuje inteligencję porównywalną z o4-mini (wysoka) i DeepSeek R1 0528. Wariant Non-reasoning oferuje inteligencję porównywalną z Kimi K2 i znacznie wyższą niż GPT-4.1 oraz Llama 4 Maverick.

➤ Qwen3 Coder 480B ma łącznie 480B parametrów, z 35B aktywnymi. Ten model jest szczególnie silny w zakresie kodowania agentowego i może być używany w różnych narzędziach dla agentów kodujących, w tym w Qwen3-Coder CLI.

Uruchomienia Cerebras reprezentują pierwszy raz, gdy ten poziom inteligencji jest dostępny przy tych prędkościach wyjściowych i mają potencjał do odblokowania nowych zastosowań - jak użycie modelu reasoning dla każdego kroku agenta bez konieczności czekania minut.

25,34K

Najlepsze

Ranking

Ulubione