Актуальные темы

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Artificial Analysis

Независимый анализ моделей ИИ и хостинг-провайдеров - выберите лучшую модель и поставщика API для вашего сценария использования

DeepSeek запускает V3.1, объединяя V3 и R1 в гибридную модель рассуждений с постепенным увеличением интеллекта

Постепенное увеличение интеллекта: Первые результаты бенчмаркинга для DeepSeek V3.1 показывают индекс искусственного анализа интеллекта 60 в режиме рассуждений, по сравнению с результатом R1 в 59. В режиме без рассуждений V3.1 достигает результата 49, что является большим увеличением по сравнению с предыдущим результатом V3 0324 в 44. Это оставляет V3.1 (рассуждение) позади последней версии Qwen3 235B 2507 от Alibaba (рассуждение) - DeepSeek не вернул лидерство.

Гибридное рассуждение: @deepseek_ai впервые перешел на гибридную модель рассуждений - поддерживая как режимы рассуждений, так и без рассуждений. Переход DeepSeek к единой гибридной модели рассуждений имитирует подход, принятый OpenAI, Anthropic и Google. Однако интересно отметить, что Alibaba недавно отказалась от гибридного подхода, который они предпочитали для Qwen3, выпустив отдельные версии моделей рассуждений и инструкций Qwen3 2507.

Вызов функций / использование инструментов: Хотя DeepSeek утверждает, что улучшил вызов функций для модели, DeepSeek V3.1 не поддерживает вызов функций в режиме рассуждений. Это, вероятно, существенно ограничит его способность поддерживать агентные рабочие процессы с требованиями к интеллекту, включая кодирующие агенты.

Использование токенов: DeepSeek V3.1 показывает постепенно более высокий результат в режиме рассуждений, чем DeepSeek R1, и использует немного меньше токенов в оценках, которые мы используем для индекса искусственного анализа интеллекта. В режиме без рассуждений он использует немного больше токенов, чем V3 0324 - но все равно в несколько раз меньше, чем в собственном режиме рассуждений.

API: Первоначальный API DeepSeek теперь обслуживает новую модель DeepSeek V3.1 как на их чат-эндпоинтах, так и на эндпоинтах рассуждений - просто изменяя, предоставляется ли токен конца размышления </think> модели в шаблоне чата, чтобы контролировать, будет ли модель рассуждать.

Архитектура: DeepSeek V3.1 архитектурно идентичен предыдущим моделям V3 и R1, с 671B общими параметрами и 37B активными параметрами.

Последствия: Мы бы посоветовали проявлять осторожность в том, чтобы делать какие-либо предположения о том, что этот релиз подразумевает о прогрессе DeepSeek к будущей модели, упоминаемой в слухах как V4 или R2. Мы отмечаем, что DeepSeek ранее выпустил последнюю модель, построенную на их архитектуре V2, 10 декабря 2024 года, всего за две недели до выпуска V3.

71,16K

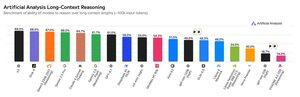

Объявляем о запуске Artificial Analysis Long Context Reasoning (AA-LCR) — нового бенчмарка для оценки производительности в условиях длинного контекста, который проверяет способности к рассуждению на основе нескольких длинных документов (~100k токенов).

Основное внимание в AA-LCR уделяется воспроизведению реальной интеллектуальной работы и задач рассуждения, тестируя способности, критически важные для современных AI-приложений, охватывающих анализ документов, понимание кодовой базы и сложные многоступенчатые рабочие процессы.

AA-LCR состоит из 100 сложных текстовых вопросов, которые требуют рассуждения на основе нескольких реальных документов, представляющих ~100k входных токенов. Вопросы разработаны так, чтобы ответы не могли быть найдены напрямую, а должны быть выведены из нескольких источников информации, при этом тестирование людьми подтверждает, что каждый вопрос требует подлинного вывода, а не простого извлечения.

Ключевые выводы:

➤ Современные ведущие модели достигают ~70% точности: три первых места занимают OpenAI o3 (69%), xAI Grok 4 (68%) и Qwen3 235B 2507 Thinking (67%)

➤👀 У нас также уже есть результаты gpt-oss! 120B показывает результаты, близкие к o4-mini (высокие), что соответствует заявлениям OpenAI о производительности модели. Вскоре мы предоставим Индекс Интеллекта для моделей.

➤ 100 сложных текстовых вопросов, охватывающих 7 категорий документов (Отчеты компаний, Отраслевые отчеты, Государственные консультации, Академия, Юридические документы, Маркетинговые материалы и Отчеты опросов)

➤ ~100k токенов входа на вопрос, что требует от моделей поддержки минимального контекстного окна в 128K для оценки по этому бенчмарку

➤ ~3M уникальных входных токенов, охватывающих ~230 документов для проведения бенчмарка (выходные токены обычно варьируются в зависимости от модели)

➤ Ссылка на набор данных на 🤗 @HuggingFace приведена ниже

Мы добавляем AA-LCR в Индекс Интеллекта Artificial Analysis и обновляем номер версии до v2.2. Индекс Интеллекта Artificial Analysis v2.2 теперь включает: MMLU-Pro, GPQA Diamond, AIME 2025, IFBench, LiveCodeBench, SciCode и AA-LCR.

Все цифры обновлены на сайте. Узнайте, какие модели входят в Индекс Интеллекта Artificial Analysis v2.2 👇

28,89K

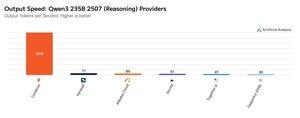

Cerebras демонстрировала свою способность хостить большие MoE на очень высоких скоростях на этой неделе, запустив конечные точки Qwen3 235B 2507 и Qwen3 Coder 480B с выходом >1,500 токенов/с

➤ @CerebrasSystems теперь предлагает конечные точки как для Qwen3 235B 2507 Reasoning, так и для Non-reasoning. Оба модели имеют 235B общих параметров с 22B активными.

➤ Qwen 3 235B 2507 Reasoning предлагает интеллект, сопоставимый с o4-mini (высокий) и DeepSeek R1 0528. Вариант Non-reasoning предлагает интеллект, сопоставимый с Kimi K2 и значительно превосходит GPT-4.1 и Llama 4 Maverick.

➤ Qwen3 Coder 480B имеет 480B общих параметров с 35B активными. Эта модель особенно сильна в агентном кодировании и может использоваться в различных инструментах кодирования агентов, включая Qwen3-Coder CLI.

Запуски Cerebras представляют собой первый случай, когда такой уровень интеллекта стал доступен на таких скоростях вывода и имеют потенциал для открытия новых случаев использования - например, использование модели рассуждения для каждого шага агента без необходимости ждать минуты.

25,34K

Топ

Рейтинг

Избранное