Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Les géants de la technologie utilisent le RAG multimodal tous les jours en production !

- Spotify l'utilise pour répondre aux requêtes musicales

- YouTube l'utilise pour transformer des invites en morceaux

- Amazon Music l'utilise pour créer des playlists à partir d'invites

Apprenons à construire un RAG agentique multimodal (avec du code) :

Aujourd'hui, nous allons construire un RAG Agentic multimodal qui peut interroger des documents et des fichiers audio en utilisant la parole de l'utilisateur.

Technologies utilisées :

- @AssemblyAI pour la transcription.

- @milvusio comme base de données vectorielle.

- @beam_cloud pour le déploiement.

- @crewAIInc Flows pour l'orchestration.

Construisons-le !

Voici le flux de travail :

- L'utilisateur saisit des données (audio + documents).

- AssemblyAI transcrit les fichiers audio.

- Le texte transcrit et les documents sont intégrés dans la base de données vectorielle Milvus.

- L'Agent de recherche récupère des informations à partir de la requête de l'utilisateur.

- L'Agent de réponse l'utilise pour formuler une réponse.

Vérifiez ceci👇

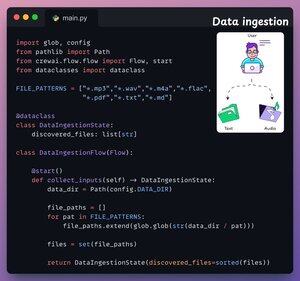

1️⃣ Ingestion des données

Pour commencer, l'utilisateur fournit les données d'entrée textuelles et audio dans le répertoire de données.

CrewAI Flow met en œuvre la logique pour découvrir les fichiers et les préparer pour un traitement ultérieur.

Vérifiez ceci👇

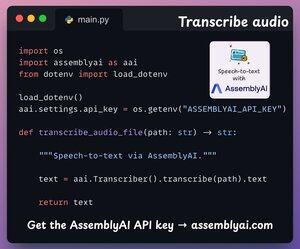

2️⃣ Transcrire l'audio

Ensuite, nous transcrivons l'entrée audio de l'utilisateur en utilisant la plateforme de reconnaissance vocale d'AssemblyAI.

AssemblyAI n'est pas open source, mais il offre de nombreux crédits gratuits pour utiliser ses modèles de transcription SOTA, qui sont plus que suffisants pour cette démonstration.

Vérifiez ceci👇

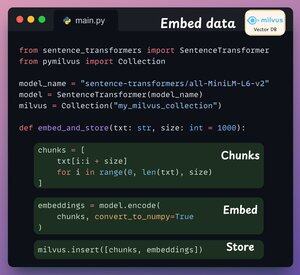

3️⃣ Intégrer les données d'entrée

Ensuite, les données d'entrée transcrites de l'étape précédente et les données textuelles d'entrée sont intégrées et stockées dans la base de données vectorielle Milvus.

Voici comment nous procédons 👇

4️⃣ Requête utilisateur

L'ingestion est terminée.

Nous passons maintenant à la phase d'inférence !

Ensuite, l'utilisateur saisit une requête vocale, qui est transcrite par AssemblyAI.

Vérifiez ceci👇

5️⃣ Récupérer le contexte

Ensuite, nous générons un embedding pour la requête et extrayons les morceaux les plus pertinents de la base de données vectorielle Milvus.

Voici comment nous procédons 👇

6️⃣ Générer une réponse

Une fois que nous avons le contexte pertinent, notre équipe est convoquée pour générer une réponse claire et citée pour l'utilisateur.

Vérifiez ceci 👇

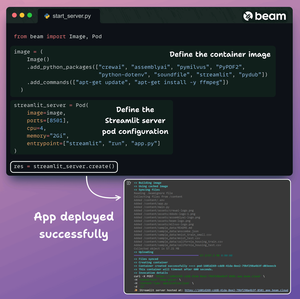

Enfin, nous regroupons tout dans une interface Streamlit propre et déployons l'application dans un conteneur sans serveur en utilisant Beam.

Nous importons les dépendances Python nécessaires et spécifions les spécifications de calcul pour le conteneur.

Et ensuite, nous déployons l'application en quelques lignes de code👇

Une fois déployé, nous obtenons un déploiement 100 % privé pour le flux de travail Agentic RAG Multimodal que nous venons de construire.

Regardez cette démo 👇

Voici le flux de travail que nous avons mis en place :

- L'utilisateur a fourni des données (audio + documents)

- AssemblyAI a transcrit les fichiers audio

- Les données transcrites sont intégrées dans la base de données vectorielle

- L'Agent de recherche a récupéré des informations à partir de la requête de l'utilisateur

- L'Agent de réponse l'a utilisé pour rédiger une réponse

Vérifiez cela👇

Si vous l’avez trouvé perspicace, partagez-le à nouveau avec votre réseau.

Trouvez-moi → @akshay_pachaar ✔️

Pour plus d’informations et de tutoriels sur les LLM, les agents d’IA et l’apprentissage automatique !

5 août, 20:30

Les géants de la technologie utilisent le RAG multimodal tous les jours en production !

- Spotify l'utilise pour répondre aux requêtes musicales

- YouTube l'utilise pour transformer des invites en morceaux

- Amazon Music l'utilise pour créer des playlists à partir d'invites

Apprenons à construire un RAG agentique multimodal (avec du code) :

106,52K

Meilleurs

Classement

Favoris