Актуальні теми

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Підприємства створюють RAG понад 100 джерел даних, а не один!

- Корпорація Майкрософт поставляє його в продуктах M365.

- Google надсилає його у своєму пошуку Vertex AI Search.

- AWS постачає його у своєму бізнесі Amazon Q.

Давайте створимо RAG на базі MCP з 200+ джерел (100% локальні):

Дані підприємства розкидані по багатьох джерелах.

Сьогодні ми побудуємо уніфікований MCP-сервер, який може запитувати 200+ джерел з одного інтерфейсу.

Технологічний стек:

- @mcpuse побудувати локальний MCP-клієнт

- @MindsDB підключення до джерел даних

- @ollama обслуговувати GPT-oss локально

Давайте почнемо!

Ось робочий процес:

- Користувач надсилає запит.

- Агент підключається до MCP-сервера MindsDB для пошуку інструментів.

- Вибирає відповідний інструмент на основі запиту користувача та викликає його

- Нарешті, він повертає контекстуально релевантну відповідь

А тепер давайте зануримося в код!

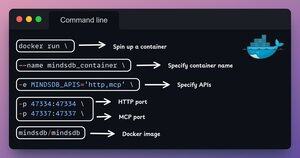

1️⃣ Налаштування Docker

MindsDB надає образи Docker, які можна запускати в контейнерах Docker.

Встановіть MindsDB локально за допомогою образу Docker, виконавши команду у вашому терміналі.

Перевірте 👇 це

2️⃣ Запустіть графічний інтерфейс MindsDB

Після встановлення образу Docker перейдіть на порт localhost 47334 у вашому браузері, щоб отримати доступ до редактора MindsDB.

За допомогою цього інтерфейсу ви можете підключатися до більш ніж 200 джерел даних і виконувати SQL-запити щодо них.

Перевірте 👇 це

3️⃣ Інтегруйте джерела даних

Давайте почнемо створювати наш движок об'єднаних запитів, підключивши наші джерела даних до MindsDB.

Ми використовуємо Slack, Gmail, GitHub і Hacker News як об'єднані джерела даних.

Перевірте 👇 це

4️⃣ Конфігурація MCP-сервера

Після створення об'єднаного двигуна запитів давайте об'єднаємо наші джерела даних, підключивши їх до MCP-сервера MindsDB.

Додайте конфігурацію MCP-сервера до файлу JSON, як показано нижче.

Перевірте 👇 це

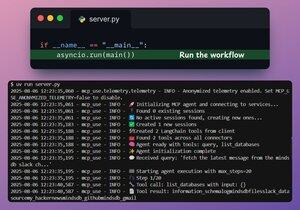

5️⃣ Підключення клієнта до сервера

Ми налаштовуємо наш локальний клієнт через mcp-use і підключаємо його до MCP-сервера за допомогою всього 4 рядків коду.

1. Ініціалізація клієнта MCP з файлу конфігурації.

2. Підключіть локальний LLM через Ollama.

3. Створіть агента за допомогою LLM та Client.

4. Виконайте запит.

Перевірте це 👇

Зробити!

Наш MCP-сервер MindsDB тепер підключений до локального клієнта через mcp-use!

Він пропонує два інструменти:

- list_databases: Список всіх джерел даних, підключених до MindsDB.

- query: відповідає на запити користувачів щодо об'єднаних даних.

Перевірте це 👇

Нарешті, ми загортаємо наше налаштування в інтерфейс Streamlit, де ми можемо динамічно змінювати конфігурацію MCP і спілкуватися безпосередньо з агентом.

Перегляньте цю демонстрацію👇

Ось і все!

Якщо ви вважаєте її зрозумілою, повторно поділіться нею зі своєю мережею.

Знайди мене → @_avichawla

Щодня я ділюся навчальними матеріалами та ідеями про DS, ML, LLM та RAG.

8 серп., 14:33

Підприємства створюють RAG понад 100 джерел даних, а не один!

- Корпорація Майкрософт поставляє його в продуктах M365.

- Google надсилає його у своєму пошуку Vertex AI Search.

- AWS постачає його у своєму бізнесі Amazon Q.

Давайте створимо RAG на базі MCP з 200+ джерел (100% локальні):

104,94K

Найкращі

Рейтинг

Вибране