Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Les entreprises construisent des RAG sur des centaines de sources de données, pas une seule !

- Microsoft l'intègre dans les produits M365.

- Google l'intègre dans sa recherche Vertex AI.

- AWS l'intègre dans son Amazon Q Business.

Construisons un RAG alimenté par MCP sur plus de 200 sources (100 % local) :

Les données d'entreprise sont éparpillées sur de nombreuses sources.

Aujourd'hui, nous allons construire un serveur MCP unifié qui peut interroger plus de 200 sources à partir d'une seule interface.

Technologies utilisées :

- @mcpuse pour construire un client MCP local

- @MindsDB pour se connecter aux sources de données

- @ollama pour servir GPT-oss localement

Commençons !

Voici le flux de travail :

- L'utilisateur soumet une requête.

- L'agent se connecte au serveur MindsDB MCP pour trouver des outils.

- Sélectionne l'outil approprié en fonction de la requête de l'utilisateur et l'invoque.

- Enfin, il renvoie une réponse contextuellement pertinente.

Maintenant, plongeons dans le code !

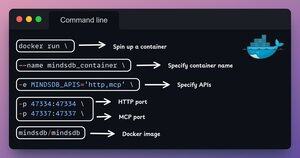

1️⃣ Configuration de Docker

MindsDB fournit des images Docker qui peuvent être exécutées dans des conteneurs Docker.

Installez MindsDB localement en utilisant l'image Docker en exécutant la commande dans votre terminal.

Vérifiez cela 👇

2️⃣ Démarrer l'interface graphique de MindsDB

Après avoir installé l'image Docker, allez sur le port 47334 de localhost dans votre navigateur pour accéder à l'éditeur MindsDB.

Grâce à cette interface, vous pouvez vous connecter à plus de 200 sources de données et exécuter des requêtes SQL contre elles.

Vérifiez cela 👇

3️⃣ Intégrer des sources de données

Commençons à construire notre moteur de requêtes fédérées en connectant nos sources de données à MindsDB.

Nous utilisons Slack, Gmail, GitHub et Hacker News comme nos sources de données fédérées.

Regardez ça 👇

4️⃣ Configuration du serveur MCP

Après avoir construit le moteur de requêtes fédérées, unifions nos sources de données en les connectant au serveur MCP de MindsDB.

Ajoutez la configuration du serveur MCP à un fichier JSON comme indiqué ci-dessous.

Regardez ça 👇

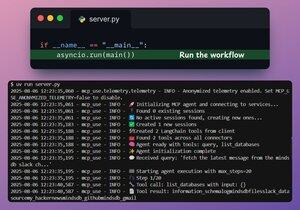

5️⃣ Connecter le client au serveur

Nous configurons notre client local via mcp-use et le connectons au serveur MCP avec seulement 4 lignes de code.

1. Initialiser le client MCP à partir d'un fichier de configuration.

2. Connecter le LLM local via Ollama.

3. Créer un Agent en utilisant le LLM et le Client.

4. Exécuter la requête.

Vérifiez ceci 👇

Fait !

Notre serveur MindsDB MCP est maintenant connecté à un client local via mcp-use !

Il offre deux outils :

- list_databases : Liste toutes les sources de données connectées à MindsDB.

- query : Répond aux requêtes des utilisateurs sur les données fédérées.

Vérifiez ceci 👇

Enfin, nous enveloppons notre configuration dans une interface Streamlit, où nous pouvons modifier dynamiquement la configuration MCP et discuter directement avec l'agent.

Découvrez cette démo👇

C'est fini !

Si vous l'avez trouvé instructif, partagez-le avec votre réseau.

Trouvez-moi → @_avichawla

Chaque jour, je partage des tutoriels et des idées sur DS, ML, LLMs et RAGs.

8 août, 14:33

Les entreprises construisent des RAG sur des centaines de sources de données, pas une seule !

- Microsoft l'intègre dans les produits M365.

- Google l'intègre dans sa recherche Vertex AI.

- AWS l'intègre dans son Amazon Q Business.

Construisons un RAG alimenté par MCP sur plus de 200 sources (100 % local) :

104,97K

Meilleurs

Classement

Favoris