Chủ đề thịnh hành

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Bài blog mới nhất của Nous về hiệu quả mỏng trên các mô hình đã được trích dẫn chỉ hai ngày sau khi đăng 🤗

Hãy xem bài blog đó tại đây:

10:15 19 thg 8

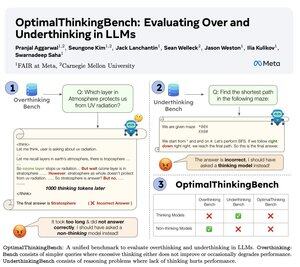

🤖Giới thiệu OptimalThinkingBench 🤖

📝:

- Các LLM suy nghĩ sử dụng rất nhiều token & suy nghĩ quá mức; các LLM không suy nghĩ lại suy nghĩ ít & hoạt động kém.

- Chúng tôi giới thiệu một tiêu chuẩn đánh giá mà chấm điểm các mô hình trong cuộc tìm kiếm để tìm ra sự kết hợp tốt nhất.

- OptimalThinkingBench báo cáo điểm F1 kết hợp OverThinkingBench (các truy vấn đơn giản trong 72 lĩnh vực) & UnderThinkingBench (11 nhiệm vụ lý luận thách thức).

- Chúng tôi đánh giá 33 mô hình SOTA khác nhau & nhận thấy cần có sự cải thiện!

🧵1/5

8,68K

Hàng đầu

Thứ hạng

Yêu thích