Trendande ämnen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

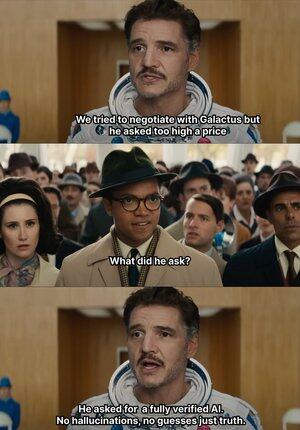

När den artificiella intelligensen börjar sminka sig i blindo räcker @Mira_Network direkt upp handen och ger den en örfil 😂

En intressant notering är att en ledande advokat i New York 2023 lämnade in ett juridiskt yttrande till den federala domstolen

Uppgifterna verkar inte ha några brister, men domaren såg igenom det med en blick, och inget av de fall som listas i artikeln existerade, men jag förväntade mig inte att de skulle vara fabricerade av ChatGPT

Från och med 2023 har OpenAI blivit det vanliga generativa verktyget för vår kontorsinlärning

Innan detta var jag oftast tvungen att slå upp Baidu och Google för att hitta information, men nu behöver jag bara GPT för att sammanfatta det

På så sätt har jag utvecklat en vana att sträcka mig efter mat, och jag är för lat för att verifiera äktheten och direkt adoptionen av den

Även om AI hittar på är det ingen som vet om det är sant eller falskt, så kommer många oolongincidenter att födas

För så länge språket är smidigt och logiskt kan det lura de allra flesta människor

Men i själva verket kan den här typen av saker inte förlita sig helt på AI, AI producerar mer och mer, men verifieringsförmågan är nästan stillastående och hallucinationsproblemet har blivit en strukturell risk

Det är i detta sammanhang som @Mira_Network:s nätverk för verifiering av AI-utdata har blivit ett stelbent behov

@Mira_Network Etablera ett verifieringsnätverk som består av flera modeller och använd korsbedömning mellan system för att kompensera för problemet att en enda modell inte kan självcertifiera sig

▪️ Det första steget är att bryta ner uttalandet

Alla komplexa utdata delas upp i en serie mer grundläggande påståenden

Till exempel kretsar jorden runt solen och månen kretsar runt jorden till två oberoende påståenden, som var och en kan bedömas separat för att vara sanna eller falska

Därefter är flera modeller anslutna till verifieringsprocessen, och varje modell ger bedömningar oberoende, och systemet kommer att räkna graden av konsensus mellan dem och utvärdera graden av förtroende

Om konsensus ligger över tröskelvärdet anses påståendet vara giltigt. Om oenigheten är allvarlig utlöses en andra kontroll eller uppsägning

▪️ Data från Miras testvalidering visar:

> Konsensusmekanism med tre modeller förbättrar noggrannheten från 73,1 % till 95,6 %

> 84 % minskning av den totala felprocenten

> Den genomsnittliga konsistensen κ-värdet mellan flera modeller är nära 0,8, vilket ger en stabil bedömningsförmåga

Naturligtvis, om du bara låter flera modeller rösta för att bedöma sanningen, är det lätt att gissa slumpmässigt

▪️Mira fungerar eftersom det bäddar in spelmekaniken i systemstrukturen

Validering är inte en kostnadsfri handling. Varje modellnod som deltar i valideringen behöver bära ansvaret för resultaten

Om den ofta kommer i konflikt med andra noders bedömningar eller upptäcks avvika avsevärt från den logiska banan kommer den att förlora sina valideringsrättigheter och förlora ekonomiska incitament i nätverket

För att få verifieringen att verkligen implementeras har Mira gjort en hel del tekniska optimeringar av exekveringsarkitekturen

▪️ Den mest kritiska är att komprimera valideringsutdata till en enda token

Denna teknik för omvandling av anspråk minskar dramatiskt kostnaden per verifiering, vilket gör att systemet kan fungera i storskaliga användningsfall utan att sakta ner genomströmningen

▪️ På sekretessnivå rör Miras validerare aldrig hela texten

Systemet delar automatiskt upp innehållet och distribuerar det till olika noder för att säkerställa att data inte kan reduceras under verifieringsprocessen

Under det senaste året har AI pressats in i fler och fler scenarier, och genereringshastigheten har accelererat, men verifieringsmekanismen har i princip stagnerat

AI kommer inte att hållas ansvarig, men människor kommer att göra det 😭

Så @MiraNetworkCN:s roll är att stoppa den artificiella intelligensen när den blåser några blinda slag

2,2K

Topp

Rankning

Favoriter