المواضيع الرائجة

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

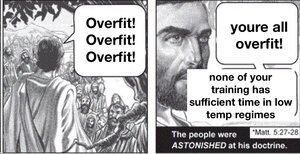

إذا قمت بتدريب نموذج ضخم ولم تقم بتنظيمه بشكل كبير للغاية ، فسوف يتناسب مع المجال. عبقرية نماذج اللغة هي أنه إذا كان المجال هو كل المعرفة البشرية التي يمكننا تدوينها ، فهناك الكثير من الأشياء التي يتم توزيعها مفيدة.

ولكن لا يوجد سبب لتوقع تعميم هذا من التوزيع ، على وجه الخصوص. لذا فإن نماذج اللغة كما تم تدريبها حاليا ستكافح دائما للتعامل مع زيادة حافة المعرفة ، على الرغم من مدى براعتها في استيفاء الفجوات.

العالم غير ثابت ، وينجرف التوزيع المستهدف بمرور الوقت. وهكذا تبدأ LLMs بشكل جيد كما ستكون في أي وقت مضى ، وتزداد سوءا ببطء بمرور الوقت. Ofc سوف يسجلون نفس الدرجات في المعايير القديمة ، لكنهم سيزدادون سوءا بمهارة في جميع مهام العالم الحقيقي.

يمكنك إصلاح هذه المشكلة إلى حد ما عن طريق تضمين بيانات من فترات زمنية متعددة والتنظيم بين العصور ، ولكن في النهاية سيؤدي ذلك إلى تعليم النموذج فقط كيفية التعامل مع الطرق التي تغير بها العالم في الماضي ، وهي مجموعة فرعية من كيفية تغييره في المستقبل.

@joaoabrantis

9 أغسطس، 23:00

هناك نوعان من التعميم في أنظمة التعلم: الهيكلية والديناميكية. يتضمن التعميم الهيكلي دمج الأبعاد المتباينة في أبعاد مفردة ، ويتضمن التعميم الديناميكي تعلم اتخاذ الإجراءات التي تمكن التعلم في المزيد من البيئات.

18.22K

الأفضل

المُتصدِّرة

التطبيقات المفضلة