Subiecte populare

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

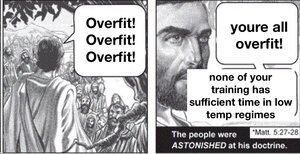

Dacă antrenezi un model masiv și nu-l regularizezi extrem de mult, acesta se va suprapotrivi domeniului. Geniul modelelor lingvistice este că, dacă domeniul este în întregime cunoștințe umane pe care le putem scrie, există o mulțime de lucruri în distribuție pentru care este util.

Dar nu există niciun motiv să ne așteptăm ca acest lucru să se generalizeze în afara distribuției, în special. Așadar, modelele lingvistice, așa cum sunt antrenate în prezent, vor avea întotdeauna dificultăți în a face față creșterii nivelului de cunoaștere, în ciuda cât de bune sunt la interpolarea lacunelor.

Lumea este nestaționară, distribuția țintei se deplasează în timp. Astfel, LLM-urile încep la fel de bine ca niciodată și se înrăutățesc încet în timp. De aceea vor obține același scor la vechile benchmark-uri, dar se vor înrăutăți subtil la toate sarcinile din lumea reală.

Puteți rezolva această problemă într-o oarecare măsură prin includerea datelor din mai multe perioade de timp și regularizarea între epoci, dar în cele din urmă asta va învăța modelul cum să gestioneze modurile în care lumea s-a schimbat în trecut, care este un subset al modului în care se va schimba în viitor.

@joaoabrantis

9 aug., 23:00

There are two kinds of generalization in learning systems: structural, and dynamic. Structural generalization involves consolidating disparate dimensions into a singular one, and dynamic generalization involves learning to take actions which enable learning in more environments.

18,46K

Limită superioară

Clasament

Favorite