Tópicos populares

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

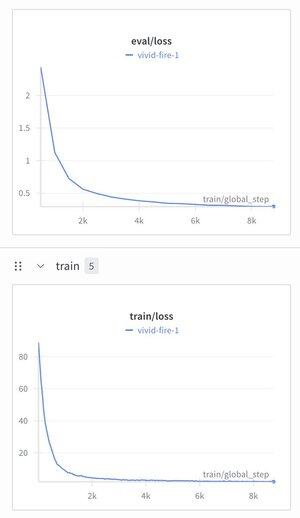

Decidi pegar o Modelo de Raciocínio Hierárquico e aplicar um tokenizador de texto nele só para ver o que aconteceria.

Treinei-o em um conjunto de dados de ajuste de instruções (Alpaca), fiquei surpreso ao ver a perda cair para ~1.9.

Produz lixo bem padronizado agora ainda, provavelmente precisa de pré-treinamento, mas isso é meio grande se funcionar...

296

Top

Classificação

Favoritos