トレンドトピック

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

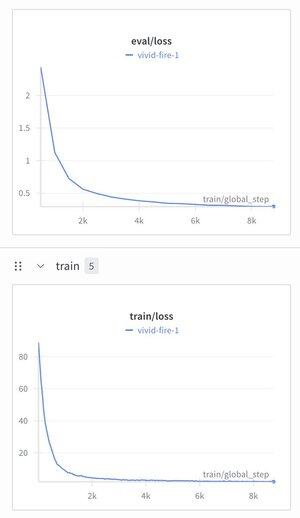

私は階層的推論モデルを採用し、その上にテキストトークナイザーを叩いて、それが起こるかを確認することにしました。

命令チューニングデータセット(Alpaca)でトレーニングしたところ、損失が~1.9に減少して驚きました。

今のところまだよくパタリングされたゴミを生成しており、おそらく事前トレーニングが必要ですが、うまくいくのであればこれはちょっと大きいです...

266

トップ

ランキング

お気に入り