Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Czy ktoś próbował tego agentycznego myśliciela LLM od ByteDance? 👀

Czy hype wokół otwartych modeli chińskich opadł?

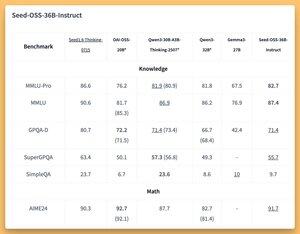

Modele 36B Instruct i Based (nawet bazowe bez danych syntetycznych) z świetnymi (SOTA?) wynikami 🤔

Jutro omówimy to w @thursdai_pod

21 sie, 04:02

ByteDance wydaje Seed-OSS (Apache-2.0): otwarta seria LLM (12T tokenów) zoptymalizowana dla 512K kontekstu, rozumowania, zadań agenta, i18n (międzynarodowe użycie). Wydanie obejmuje Seed-OSS-36B-Base (z danymi syntetycznymi i bez) oraz Seed-OSS-36B-Instruct

- Arch: 36B parametrów, 64L, ukryty 5120, słownik 155K, GQA (80/8/8, głowa 128), SwiGLU, RMSNorm, RoPE baza 1e7

- Budżet myślenia: Kontrola długości rozumowania (wielokrotności 512), CoT samorefleksja, 0 = bezpośrednie odpowiedzi, domyślnie = nieograniczone

36B-Base (z vs bez syn.)

- MMLU-Pro 65.1 / 60.4 | MMLU 84.9 / 84.8 | TriviaQA 82.1 / 81.9 | GPQA-D 31.7 / 35.2

- BBH 87.7 / 87.2 | AGIEval-en 70.7 / 70.1

- GSM8K 90.8 / 90.3 | MATH 81.7 SOTA / 61.3

- MBPP 80.6 / 74.6 | HumanEval 76.8 / 75.6

36B-Instruct

- MMLU-Pro 82.7 | MMLU 87.4 | GPQA-D 71.4 | SuperGPQA 55.7

- AIME24 91.7 SOTA | AIME25 84.7 | BeyondAIME 65

- ArcAGI V2 40.6 | KORBench 70.6

- LiveCodeBench v6 67.4 SOTA | HLE 10.1

- IFEval 85.8 | TAU1-Retail 70.4 SOTA | TAU1-Airline 46

- SWE-Bench Zweryfikowane 56 SOTA | Multi-SWE-Bench 17

- MMMLU 78.4 | RULER (128K) 94.6 SOTA | AIR-Bench 75.6

Wnioskowanie: Transformers, vLLM (≥0.10.0), FlashAttention2, kwantyzacja 4/8-bitowa

162

Najlepsze

Ranking

Ulubione