Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Quelqu'un a-t-il essayé ce LLM de penseur agentique de ByteDance ? 👀

Ou est-ce que l'engouement autour des modèles chinois open source est en baisse ?

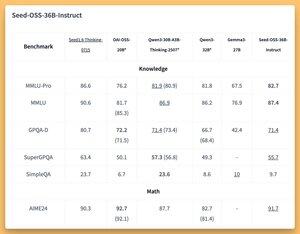

Modèles Instruct et Based de 36B (même de base sans données synthétiques) avec d'excellentes performances (SOTA ?) 🤔

Nous allons en parler demain sur @thursdai_pod.

21 août, 04:02

ByteDance publie Seed-OSS (Apache-2.0) : série LLM ouverte (12T tokens) optimisée pour 512K ctx, raisonnement, tâches d'agent, i18n (utilisation internationale). La publication inclut Seed-OSS-36B-Base (avec et sans données synthétiques) et Seed-OSS-36B-Instruct

- Architecture : 36B params, 64L, caché 5120, vocab 155K, GQA (80/8/8, tête 128), SwiGLU, RMSNorm, RoPE base 1e7

- Budget de réflexion : Contrôler la longueur du raisonnement (multiples de 512), auto-réflexion CoT, 0 = réponses directes, par défaut = illimité

36B-Base (avec vs sans syn.)

- MMLU-Pro 65.1 / 60.4 | MMLU 84.9 / 84.8 | TriviaQA 82.1 / 81.9 | GPQA-D 31.7 / 35.2

- BBH 87.7 / 87.2 | AGIEval-en 70.7 / 70.1

- GSM8K 90.8 / 90.3 | MATH 81.7 SOTA / 61.3

- MBPP 80.6 / 74.6 | HumanEval 76.8 / 75.6

36B-Instruct

- MMLU-Pro 82.7 | MMLU 87.4 | GPQA-D 71.4 | SuperGPQA 55.7

- AIME24 91.7 SOTA | AIME25 84.7 | BeyondAIME 65

- ArcAGI V2 40.6 | KORBench 70.6

- LiveCodeBench v6 67.4 SOTA | HLE 10.1

- IFEval 85.8 | TAU1-Retail 70.4 SOTA | TAU1-Airline 46

- SWE-Bench Vérifié 56 SOTA | Multi-SWE-Bench 17

- MMMLU 78.4 | RULER (128K) 94.6 SOTA | AIR-Bench 75.6

Inférence : Transformers, vLLM (≥0.10.0), FlashAttention2, quantification 4/8 bits

156

Meilleurs

Classement

Favoris