Tópicos populares

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

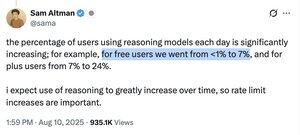

Já disse isso cem vezes, mas continuarei a dizer: a adoção de IA e a mudança de comportamento são lentas — e continuarão lentas — não importa quão rapidamente as capacidades melhorem. A estatística na captura de tela vale a pena refletir: quase um ano após o lançamento dos modelos "pensantes", apenas uma pequena fração de usuários os estava utilizando (até que o comutador automático do GPT-5 silenciosamente aumentou os números).

Isso é exatamente o que devemos esperar. A narrativa dominante é que a IA está sendo adotada a uma velocidade sem precedentes, mas isso se baseia em quantas pessoas a experimentaram, ignorando como estão a usá-la, por quanto tempo a utilizam a cada dia e quanto estão a obter dela. Mesmo inovações que salvam vidas levam muito tempo para se disseminar pela população. Esta é uma característica do comportamento humano, não da tecnologia em questão, portanto, não devemos esperar que a IA seja diferente. (Para mais sobre isso, veja IA como Tecnologia Normal.)

Alguns argumentarão que o comutador automático do GPT-5 prova que os desenvolvedores podem basicamente forçar a IA nas pessoas rapidamente. Absolutamente não. O comutador de modelo foi um problema criado pela própria OpenAI, então a OpenAI conseguiu resolvê-lo. Mudar para um modelo pensante por trás das cenas não requer que o usuário aprenda novas habilidades ou comportamentos ou mude seus fluxos de trabalho. É revelador que a OpenAI não conseguiu integrar de forma semelhante o Deep Research ou o Modo Agente, que realmente requerem adaptação do usuário — especialmente este último, onde os usuários têm que aprender a supervisionar o modelo, comunicar os requisitos da tarefa com precisão, tomar decisões complexas e potencialmente arriscadas sobre segurança, e achar tudo isso útil o suficiente para querer abrir suas carteiras.

26,44K

Top

Classificação

Favoritos