Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

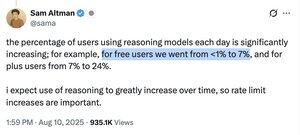

Mówiłem to już setki razy, ale będę to powtarzać: przyjęcie AI i zmiana zachowań są powolne — i będą pozostawać powolne — niezależnie od tego, jak szybko poprawiają się możliwości. Statystyka na zrzucie ekranu jest warta przemyślenia: niemal rok po wydaniu modeli "myślących", tylko niewielka część użytkowników z nich korzystała (aż do momentu, gdy automatyczny przełącznik GPT-5 cicho zwiększył te liczby).

To dokładnie to, czego powinniśmy się spodziewać. Dominująca narracja głosi, że AI jest przyjmowane w niespotykanym tempie, ale opiera się to na tym, ile osób to wypróbowało, ignorując to, jak z tego korzystają, jak długo używają tego każdego dnia i ile z tego wynoszą. Nawet innowacje ratujące życie potrzebują dużo czasu, aby przeniknąć do populacji. To cecha ludzkiego zachowania, a nie technologii, więc nie powinniśmy oczekiwać, że AI będzie pod tym względem inna. (Więcej na ten temat w artykule AI jako normalna technologia.)

Niektórzy będą argumentować, że automatyczny przełącznik GPT-5 dowodzi, że deweloperzy mogą w zasadzie szybko narzucić AI ludziom. Absolutnie nie. Przełącznik modeli był problemem stworzonym przez OpenAI, więc OpenAI mogło go rozwiązać. Przełączenie na model myślący w tle nie wymaga od użytkownika nauki nowych umiejętności ani zachowań ani zmiany ich przepływów pracy. Zaskakujące jest, że OpenAI nie było w stanie w podobny sposób zintegrować Deep Research ani trybu Agenta, które wymagają adaptacji użytkownika — zwłaszcza tego drugiego, gdzie użytkownicy muszą nauczyć się nadzorować model, precyzyjnie komunikować wymagania zadania, podejmować złożone i potencjalnie ryzykowne decyzje dotyczące bezpieczeństwa oraz uznać to wszystko za na tyle użyteczne, aby chcieć otworzyć swoje portfele.

26,43K

Najlepsze

Ranking

Ulubione