Temas en tendencia

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

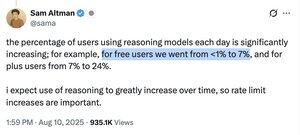

He dicho esto cien veces, pero seguiré diciéndolo: la adopción de la IA y el cambio de comportamiento son lentos — y seguirán siendo lentos — sin importar cuán rápido mejoren las capacidades. La estadística en la captura de pantalla vale la pena reflexionarla: casi un año después del lanzamiento de los modelos "pensantes", solo una pequeña fracción de los usuarios los estaba utilizando (hasta que el conmutador automático de GPT-5 aumentó silenciosamente los números).

Esto es exactamente lo que deberíamos esperar. La narrativa dominante es que la IA se está adoptando a una velocidad sin precedentes, pero eso se basa en cuántas personas la han probado, ignorando cómo la están utilizando, cuánto tiempo la usan cada día y cuánto están obteniendo de ella. Incluso las innovaciones que salvan vidas tardan mucho en filtrarse a través de la población. Esta es una propiedad del comportamiento humano, no de la tecnología en cuestión, por lo que no deberíamos esperar que la IA sea diferente. (Para más sobre esto, ver IA como Tecnología Normal.)

Algunos argumentarán que el conmutador automático de GPT-5 prueba que los desarrolladores pueden básicamente forzar la IA a las personas rápidamente. Absolutamente no. El conmutador de modelos fue un problema creado por OpenAI, por lo que OpenAI pudo resolverlo. Cambiar a un modelo pensante bajo el capó no requiere que el usuario aprenda nuevas habilidades o comportamientos o cambie sus flujos de trabajo. Es revelador que OpenAI no ha podido integrar de manera similar Deep Research o Agent Mode, que sí requieren adaptación del usuario — especialmente este último, donde los usuarios tienen que aprender a supervisar el modelo, comunicar los requisitos de la tarea con precisión, tomar decisiones complejas y potencialmente arriesgadas sobre seguridad, y encontrar todo esto lo suficientemente útil como para querer abrir sus billeteras.

26.43K

Populares

Ranking

Favoritas