Trendande ämnen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

4 steg av utbildning LLM:er från grunden, tydligt förklarade (med bilder):

Idag täcker vi de 4 stegen för att bygga LLM:er från grunden för att göra dem tillämpliga för verkliga användningsfall.

Vi kommer att täcka:

- Förberedande träning

- Finjustering av instruktioner

- Finjustering av preferenser

- Finjustering av resonemang

Det visuella objektet sammanfattar dessa tekniker.

Låt oss dyka in!

0️⃣ Slumpmässigt initierad LLM

I det här läget vet modellen ingenting.

Du frågar den "Vad är en LLM?" och får rappakalja som "prova peter hand och hej 448Sn".

Den har inte sett några data ännu och har bara slumpmässiga vikter.

Kolla in det här 👇

1️⃣ Förberedande träning

Detta steg lär LLM grunderna i språk genom att träna det på massiva korpusar för att förutsäga nästa token. På så sätt absorberar den grammatik, världsfakta etc.

Men den är inte bra på konversation eftersom den bara fortsätter texten när den uppmanas att göra det.

Kolla in det här 👇

2️⃣ Finjustering av instruktioner

För att göra det konversationsmässigt gör vi finjustering av instruktioner genom att träna på instruktion-svarpar. Detta hjälper den att lära sig att följa anvisningar och formatera svar.

Nu kan den:

- Svara på frågor

- Sammanfatta innehållet

- Skriva kod m.m.

Kolla in det här 👇

Vid det här laget har vi sannolikt:

- Utnyttjade hela det råa internetarkivet och kunskapen.

- Budgeten för mänskligt märkta instruktionssvarsdata.

Så vad kan vi göra för att ytterligare förbättra modellen?

Vi går in på Reinforcement Learnings (RL) territorium.

Låt oss lära oss härnäst 👇

3️⃣ Finjustering av preferenser (PFT)

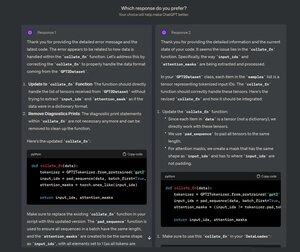

Du måste ha sett den här skärmen på ChatGPT där den frågar: Vilket svar föredrar du?

Det är inte bara för feedback, utan det är värdefull data om mänskliga preferenser.

OpenAI använder detta för att finjustera sina modeller med hjälp av finjustering av inställningar.

Kolla in det här 👇

I PFT:

Användaren väljer mellan 2 svar för att producera data om mänskliga preferenser.

En belöningsmodell tränas sedan för att förutsäga mänsklig preferens och LLM uppdateras med hjälp av RL.

Kolla in det här 👇

Ovanstående process kallas RLHF (Reinforcement Learning with Human Feedback) och algoritmen som används för att uppdatera modellvikter kallas PPO.

Det lär LLM att anpassa sig till människor även när det inte finns något "korrekt" svar.

Men vi kan förbättra LLM ännu mer.

Låt oss lära oss härnäst👇

4️⃣ Resonemang finjustering

I resonemangsuppgifter (matematik, logik, etc.) finns det vanligtvis bara ett korrekt svar och en definierad serie steg för att få svaret.

Så vi behöver inte mänskliga preferenser, och vi kan använda korrekthet som signal.

Detta kallas för finjustering👇 av resonemang

Trappsteg:

- Modellen genererar ett svar på en fråga.

- Svaret jämförs med det kända rätta svaret.

- Baserat på korrektheten tilldelar vi en belöning.

Detta kallas Reinforcement Learning with Verifierable Rewards.

GRPO från DeepSeek är en populär teknik.

Kolla in det här👇

Det var de 4 stadierna av att träna en LLM från grunden.

- Börja med en slumpmässigt initierad modell.

- Förträna den på storskaliga korpusar.

- Använd finjustering av instruktioner för att få den att följa kommandona.

- Använd finjustering av preferenser och resonemang för att skärpa svaren.

Kolla in det här 👇

Om du tyckte att det var insiktsfullt, dela det igen med ditt nätverk.

Hitta mig → @_avichawla

Varje dag delar jag med mig av handledningar och insikter om DS, ML, LLM och RAGs.

21 juli 2025

4 steg av utbildning LLM:er från grunden, tydligt förklarade (med bilder):

@tasiorek27 Finjustering av förstärkning:

Finjustering av instruktioner: (Det här handlar inte om träning i sig, utan snarare om att generera en datauppsättning för finjustering av instruktioner)

6 maj 2025

Låt oss skapa vår egen LLM-finjusteringsdatauppsättning (100 % lokal):

714,17K

Topp

Rankning

Favoriter