Temas en tendencia

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

¡El código abierto gana!!

El 11 de julio, Kimi K2 (@Kimi_Moonshot) se lanzó después de 6 meses de desarrollo a puerta cerrada. El modelo tuvo un rendimiento excepcional y rápidamente reclamó el título de "el mejor modelo LLM de código abierto".

De hecho, al día siguiente de que Moonshot anunciara Kimi K2, el CEO de OpenAI, Sam Altman, pospuso urgentemente el lanzamiento de su próximo modelo de código abierto debido a "razones de seguridad", lo que dejó a la gente preguntándose.

Aquí hay un desglose técnico del nuevo modelo LLM de última generación que no solo rivaliza con gigantes de la industria como ChatGPT y Claude, sino que también desafía los límites de un buen modelo de código abierto👇🧵

2/5: Kimi K2 es un modelo de mezcla de expertos (MoE) con 32 mil millones de parámetros activados, entrenado en 15.5T tokens, con una base de conocimientos hasta abril de 2025.

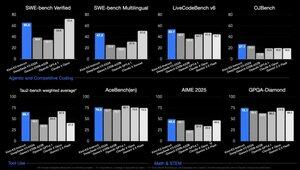

Kimi se especializa en tareas de codificación y agentes, con un puntaje en SWE-bench que supera a todos los pares de código abierto, como DeepSeek V3 y Qwen3. Incluso supera a algunos modelos propietarios como GPT-4.1 de OpenAI y Claude 4 Opus en tareas de codificación competitiva de un solo aviso.

También sobresale en el uso de herramientas, con uno de los mejores puntajes en el benchmark Tau2 de código abierto, siguiendo de cerca a Claude 4 Opus.

3/5: La API de Kimi es compatible con OpenAI y Anthropic, lo que significa que puedes exportar directamente las claves de autenticación desde y usarlas en el código de Claude para reemplazar Opus o Sonnet. También es compatible con Cline, lo que significa que puedes probar Kimi K2 en la mayoría de los IDEs de codificación desde su API.

Sin embargo, hay un pequeño detalle a tener en cuenta: se requiere un depósito mínimo de alrededor de $15 (100 RMB) para desbloquear un RPM razonable (500). La razón dada por Moonshot es prevenir ataques maliciosos. Si bien la precaución es comprensible dada la popularidad del modelo, el desarrollo futuro debería priorizar la mejora de la accesibilidad para los usuarios.

5/5: ¿Quieres aprender más? ¡Lee su documentación!

1.43K

Populares

Ranking

Favoritas