Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Open Source für den Sieg!!

Am 11. Juli hat Kimi K2 (@Kimi_Moonshot) nach 6 Monaten geschlossener Entwicklung gestartet. Das Modell hat herausragend abgeschnitten und schnell den Titel "das beste Open-Source-LLM-Modell" beansprucht.

Tatsächlich hat der CEO von OpenAI, Sam Altman, am Tag nach der Ankündigung von Kimi K2 die Veröffentlichung ihres nächsten Open-Source-Modells aufgrund von "Sicherheitsgründen" dringend verschoben, was die Leute zum Nachdenken brachte.

Hier ist eine technische Analyse des neuen, hochmodernen LLM, das nicht nur mit proprietären Branchenriesen wie ChatGPT und Claude konkurriert, sondern auch die Grenzen eines guten Open-Source-Modells herausfordert👇🧵

2/5: Kimi K2 ist ein Mischung-von-Experten (MoE) Modell mit 32 Milliarden aktivierten Parametern, das auf 15,5 Billionen Tokens trainiert wurde, mit einer Wissensbasis bis April 2025.

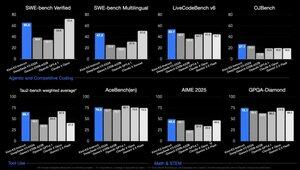

Kimi spezialisiert sich auf Programmierung und agentische Aufgaben, mit einem SWE-bench Score, der alle Open-Source-Konkurrenten übertrifft, wie DeepSeek V3 und Qwen3. Es übertrifft sogar einige proprietäre Modelle wie OpenAI’s GPT-4.1 und Claude 4 Opus bei wettbewerbsfähigen Programmieraufgaben mit einem einzelnen Prompt.

Es glänzt auch in der Nutzung von Werkzeugen, mit einem der besten Open-Source Tau2 Benchmark Scores, der eng hinter Claude 4 Opus liegt.

3/5: Kimi’s API wird von OpenAI und Anthropic unterstützt, was bedeutet, dass Sie die Authentifizierungsschlüssel direkt exportieren und sie im Claude-Code verwenden können, um Opus oder Sonnet zu ersetzen. Es unterstützt auch Cline, was bedeutet, dass Sie Kimi K2 in den meisten Coding-IDEs über seine API ausprobieren können.

Es gibt jedoch eine kleine Sache zu beachten: Eine Mindesteinzahlung von etwa 15 $ (100 RMB) ist erforderlich, um eine angemessene RPM (500) freizuschalten. Der von Moonshot angegebene Grund ist, böswillige Angriffe zu verhindern. Während die Vorsicht angesichts der Beliebtheit des Modells verständlich ist, sollte die zukünftige Entwicklung die Verbesserung der Zugänglichkeit für die Benutzer priorisieren.

5/5: Möchten Sie mehr erfahren? Lesen Sie deren Dokumentation!

1,43K

Top

Ranking

Favoriten