Trendande ämnen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Här är veckans Ritual Research Digest, ett nyhetsbrev som täcker det senaste i LLM-världen och skärningspunkten mellan Crypto x AI.

Med hundratals artiklar som publiceras varje vecka är det omöjligt att hålla sig uppdaterad med det senaste. Vi gör avläsningen så att du inte behöver.

GRPO med flera moduler: Komponera policygradienter och promptoptimering för språkmodellprogram

I det här dokumentet undersöks om efterträning kan tillämpas på ramverk för snabb optimering.

Detta är den första implementeringen av GRPO till komplexa LLM-pipelines. Metoden MM-GRPO förbättrar prestationen med 7% i genomsnitt mot vanilj CoT. Även om det inte alltid överträffar snabb optimering, är det alltid ett effektivt komplement.

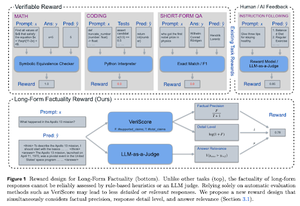

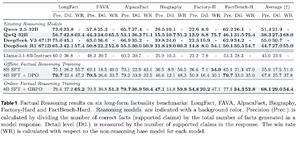

Att lära sig att resonera kring saklighet

Denna uppsats utvecklar en belöningsfunktion för att träna lång CoT (Chain of Thought) för saklighet. Deras design slutar belöna hacking genom att gynna precision, detaljer och kvalitet på samma gång.

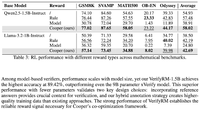

De finner att deras belöningsfunktion i RL överträffar basmodellen (Llama-3.1-8B-Instruct) i alla mätvärden över flera datamängder. Befintliga resonemang LLM:er (QwQ, R1) lider av fakticitetsminskning jämfört med deras basmodell (Qwen 2.5 32B, DS v3).

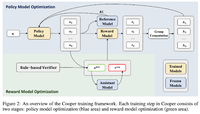

Cooper: Co-optimering av policy- och belöningsmodeller i förstärkningsinlärning för stora språkmodeller

I denna uppsats föreslår de en RL-metod, Cooper, som tränar policymodellen och belöningsmodellen samtidigt.

De släpper en datauppsättning för belöningsmodellering, som är märkt med hjälp av en strategi som kombinerar regelbaserad och LLM-som-en-domare-verifiering. De finner att dynamisk justering av belöningsmodellen under RL effektivt kan mildra belöningshackning.

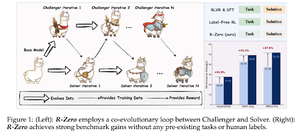

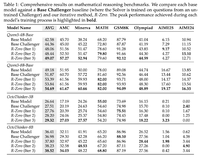

R-Zero: Självutvecklande resonemang LLM från Zero Data

I det här dokumentet föreslår de R-Zero för att träna resonerande LLM:er som kan självutvecklas från 0 externa data. Samma modell initieras med två roller (utmanare/lösare) som utvecklas tillsammans i RL.

Utmanaren belönas för att ha skapat uppgifter som är svåra för Problemlösarens nuvarande förmågor, medan Lösaren belönas för att lösa de allt svårare uppgifter som utmanaren ställer. R-Zero är ett modellagnostiskt ramverk, och de visar vinster på Qwen3-4b-modellen.

De presenterar också CompassVerifier, en familj av robusta verifieringsmodeller. Tränad med data från den ursprungliga bänken, formelförbättrade data och hallucinationsdata. Deras modell presterar bättre än andra modeller som Qwen2.5 och 3-serien och är också till hjälp som belöningsmodell.

Följ oss @ritualdigest för mer information om allt som rör forskning om Crypto x AI och @ritualnet för att lära dig mer om vad Ritual bygger.

6,2K

Topp

Rankning

Favoriter