المواضيع الرائجة

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

تثاءب 🥱

حتى Meituan (شركة تطبيقات التوصيل ~ DoorDash) تشحن الحدود LLM >> Meta. يصف المنشور الذي أقتبس أدناه العديد من الحيل الفنية SOTA المستخدمة في نموذج 560B MoE.

قبل سنوات التقيت بمدرب فريق المنظمة البحرية الدولية لجمهورية الصين الشعبية في بكين. أخبرني أنه يمكنهم إرسال فرق متعددة من الحاصلين على الميداليات الذهبية كل عام إذا أرادوا ذلك. يدعم أداء فرق genAI في الصين هذا - لقد فقدت عدد النماذج المنتجة هناك والتي >> Meta و SOTA.

~ نصف مواهب الذكاء الاصطناعي في العالم موجودة في الصين ونصف مواهب الذكاء الاصطناعي الأمريكية من الصين.

بالنسبة للأمريكيين الجاهلين الذين لا يكلفون أنفسهم عناء اتباع أكبر اقتصاد وأكثرها ابتكارا في العالم:

Meituan (الصينية: 美團; بينيين: Měituán ، حرفيا "مجموعة جميلة" ؛ Meituan-Dianping سابقا ، حرفيا "مجموعة جميلة - مراجعات") هي شركة تكنولوجيا صينية تقدم منصة لمجموعة واسعة من المستهلكين المحليين ، بما في ذلك توصيل الطعام والمطاعم المراجعات وحجوزات السفر وخدمات البيع بالتجزئة. يقع المقر الرئيسي للشركة في بكين وتأسست في عام 2010 من قبل وانغ شينغ.

31 أغسطس 2025

التقرير الفني ل @Meituan_LongCat LongCat-Flash جيد للغاية ومليء بالحداثة.

النموذج عبارة عن وزارة تربية وتعليم نشطة 560B سلبية ~ 27B مع عدد تكيفي من المعلمات النشطة اعتمادا على السياق بفضل خبير الحساب الصفر.

1) الهندسة المعمارية الجديدة

تحتوي > Layers على كتلتين من Attention و FFN و MoE ، وبهذه الطريقة يمكنك تداخل 2 coms الشاملة. (كما أنها 28 طبقة فقط ولكن عليك أن تأخذ في الاعتبار كتلتي الانتباه).

> يضيفون الخبير الحسابي الصفري الذي يمكن للرموز المميزة اختياره وعدم القيام بأي شيء ، مثل "الحوض" للرموز المميزة السهلة.

> بالنسبة لموازنة التحميل ، لديهم خسارة aux تشبه dsv3 مجانا لتعيين متوسط الخبير الحقيقي / المزيف لكل رمز مميز. يطبقون جدول اضمحلال على تحديث التحيز هذا. كما أنهم يقومون بالتحكم في توازن الخسارة.

2) التحجيم

> قاموا بإجراء تغييرات على MLA / MoE للحصول على محاذاة التباين عند البداية. المكاسب مثيرة للإعجاب في الشكل 5 ، لكنني لا أعرف إلى أي مدى سيكون لهذا التأثير لاحقا.

> نمو النموذج في الأمر رائع جدا ، فإنهم يقومون أولا بتدريب نموذج أصغر بمقدار 2x ثم "عندما يتم تدريبه بشكل كاف" (غير واضح بعض الشيء هنا عدد الرموز المميزة B) يقومون بإدخال النموذج النهائي بمجرد تكديس طبقات النموذج الأصغر.

> استخدموا @_katieeverett @Locchiu و al. الورق لنقل المعلمات الفائقة مع SP بدلا من muP للنموذج الأصغر 2x ig.

3) الاستقرار

> يتتبعون نسبة معيار التدرج وتشابه جيب التمام بين الخبراء لضبط وزن خسارة موازنة الحمل (يوصون بنسبة معيار التدرج <0.1). > لتجنب عمليات التنشيط الكبيرة ، يقومون بتطبيق خسارة z على الحالة المخفية ، مع coef صغير جدا (بديل آخر ل qk-clip / norm).

> قاموا بتعيين Adam epsilon على 1e-16 وأظهروا أنك تريده أن يكون أقل من نطاق RMS المتدرج.

4) أخرى

> يتدربون على رموز 20T للمرحلة 1 ، و "T متعددة من الرموز المميزة" للتدريب المتوسط على بيانات STEM / الكود (70٪ من الخليط) ، و 100B لتمديد السياق الطويل بدون خيوط (80B ل 32k ، و 20B ل 128k). تمثل مستندات السياق الطويل 25٪ من الخليط (لست متأكدا مما إذا كانت النسبة المئوية للمستندات أو الرموز المميزة ، والتي تتغير كثيرا هنا).

> مسار بيانات التدريب المسبق هو استخراج السياق ، وتصفية الجودة ، والتراجع عن البيانات.

> ملحق لطيف حيث يظهرون أنهم يقارنون top_k المطلوبة لمعايير مختلفة (MMLU أعلى مع 8.32 ، وأقل GSM8K مع 7.46). كما أنها تقارن تخصيص الرمز المميز في الطبقات العميقة / الضحلة.

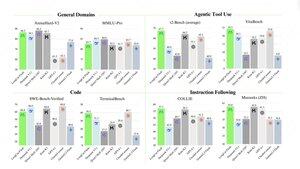

> يطلقون معيارين جديدين Meeseek (متعدد المنعطفات IF) و VitaBench (سيناريو الأعمال في العالم الحقيقي).

> الكثير من التفاصيل في البنية التحتية / الاستدلال مع معلومات حول قبول فك التشفير التخميني ، والتكميم ، والنشر ، وتحسين النواة ، وتداخل coms ، وما إلى ذلك.

> قائمة الورق المرتبط المختلفة في الخيط 🧵

14.23K

الأفضل

المُتصدِّرة

التطبيقات المفضلة