热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

YAWN 🥱

Even Meituan (delivery app company ~ DoorDash) ships frontier LLM >> Meta. Post I quote below describes many SOTA technical tricks used in the 560B MoE model.

Years ago I met with the coach of the PRC IMO team in Beijing. He told me they could field multiple teams of gold medalists each year if they wanted to. The performance of genAI teams in China supports this - I've lost count of the number of models produced there that are >> Meta and SOTA.

~Half the AI talent in the world is IN China and half the US AI talent is FROM China.

For clueless Americans who don't bother to follow the largest and (arguably) most innovative economy in the world:

Meituan (Chinese: 美团; pinyin: Měituán, literally "beautiful group"; formerly Meituan–Dianping, literally "beautiful group–reviews") is a Chinese technology company that offers a platform for a wide range of local consumer, including food delivery, restaurant reviews, travel bookings, and retail services. The company is headquartered in Beijing and was founded in 2010 by Wang Xing.

22 小时前

@Meituan_LongCat 的 LongCat-Flash 技术报告非常出色,充满了新颖性。

该模型是一个 560B 被动 ~27B 活动 MoE,具有根据上下文自适应的活动参数数量,这要归功于零计算专家。

1) 新架构

> 层具有 2 个注意力块,同时包含 FFN 和 MoE,这样可以重叠这两个全连接通信。(虽然只有 28 层,但必须考虑到 2 个注意力块)。

> 他们添加了零计算专家,令标记可以选择并不做任何事情,有点像“水槽”用于简单标记。

> 为了负载均衡,他们有一个类似 dsv3 的辅助损失,可以自由设置每个标记的真实/虚假专家的平均值。他们对这个偏差更新应用了衰减计划。他们还进行了损失平衡控制。

2) 扩展

> 他们对 MLA/MoE 进行了更改,以在初始化时实现方差对齐。图 5 中的增益相当令人印象深刻,但我不知道这在后期会产生多大影响。

> 模型增长初始化相当酷,他们首先训练一个小 2 倍的模型,然后“当它训练得足够好时”(这里不太清楚需要多少 B 个标记)通过简单堆叠小模型的层来初始化最终模型。

> 他们使用了 @_katieeverett @Locchiu 等人的论文,通过 SP 而不是 muP 进行超参数转移,以适应 2 倍小的模型。

3) 稳定性

> 他们跟踪梯度范数比和专家之间的余弦相似度,以调整负载均衡损失的权重(他们建议梯度范数比 <0.1)。

> 为了避免大激活,他们对隐藏状态应用了 z-loss,系数相当小(这是 qk-clip/norm 的另一种替代方案)。

> 他们将 Adam 的 epsilon 设置为 1e-16,并表明希望其低于梯度 RMS 范围。

4) 其他

> 他们在阶段 1 上训练了 20T 个标记,在 STEM/code 数据上进行中期训练时“多个 T 的标记”(混合物的 70%),在没有纱线的情况下进行长上下文扩展时为 100B(32k 为 80B,128k 为 20B)。长上下文文档占混合物的 25%(不确定这是文档的百分比还是标记的百分比,这里变化很大)。

> 预训练数据管道是上下文提取、质量过滤、去重。

> 附录中很好地展示了他们比较不同基准所需的 top_k(MMLU 较高为 8.32,GSM8K 较低为 7.46)。他们还比较了深层/浅层的标记分配。

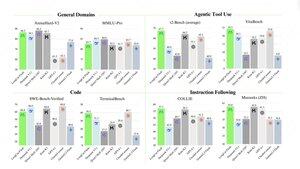

> 他们发布了两个新的基准 Meeseeks(多轮 IF)和 VitaBench(现实世界商业场景)。

> 在基础设施/推理方面有很多细节,包括关于投机解码接受、量化、部署、内核优化、通信重叠等的信息。

> 线程中列出了不同的相关论文 🧵

11.91K

热门

排行

收藏